大数据

大数据概念

- 大数据(Big Data):指无法在一定时间范围内用常规软件工具进行捕捉、管理和处理的数据集合,是需要新处理模式才能具有更强的决策力、洞察发现力和流程优化能力的海量、高增长率和多样化的信息资产。

- 大数据主要解决,海量数据的采集、存储和分析计算问题。

- 按顺序给出数据存储单位:bit、Byte、KB、MB、GB、TB、PB、EB、ZB、YB、BB、NB、DB。

1 Byte = 8 bit,1 KB = 1024 Byte,1 MB = 1024 KB,1 GB = 1024 MB,1 TB = 1024 GB,1 PB= 1024 TB

大数据特点

- Volume(大量)

- 截至目前,人类生产的所有印刷材料的数据量是 200 PB,而历史上全人类总共说过的话的数据量大约是 5 EB。当前,典型个人计算机硬盘的容量为 TB 量级,而一些大企业的数据量已经接近 EB 量级。

- Velocity(高速)

- 这是大数据区分于传统数据挖掘的最显著特征。根据 IDC 的“数字宇宙”的报告,预计到 2025 年,全球数据使用量将达到 163 ZB。在如此海量的数据面前,处理数据的效率就是企业的生命。

- 天猫双十一:2017 年,3 分 01 秒,天猫交易额超过 100 亿;2020 年,96 秒,天猫交易额超过 100 亿。

- Variety(多样)

- 这种类型的多样性也让数据被分为结构化数据和非结构化数据。相对于以往便于存储的以数据库/文本为主的结构化数据,非结构化数据越来越多,包括网络日志、音频、视频、图片、地理位置信息等,这些多类型的数据对数据的处理能力提出了更高要求。

- Value(低价值密度)

- 价值密度的高低与数据总量的大小成反比。比如,在一天的监控视频中,我们只关心宋老师晚上在床上健身那一分钟,如何快速对有价值数据“提纯”,成为目前大数据背景下待解决的难题。

Hadoop 概述

Hadoop 是什么

Hadoop 是一个由 Apache 基金会所开发的分布式系统基础架构。

主要解决,海量数据的存储和海量数据的分析计算问题。

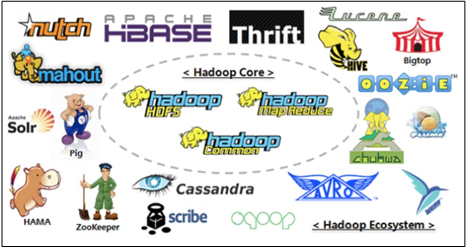

广义上来说,Hadoop 通常是指一个更广泛的概念 — Hadoop 生态圈。

Hadoop 发展历史

Hadoop 创始人 Doug Cutting,为了实现与 Google 类似的全文搜索功能,他在 Lucene 框架基础上进行优化升级,查询引擎和索引引擎。

2001 年年底,Lucene 成为 Apache 基金会的一个子项目。

对于海量数据的场景,Lucene 框架面对与 Google 同样的困难,存储海量数据困难,检索海量速度慢。

学习和模仿 Google 解决这些问题的办法:微型版 Nutch。

可以说 Google 是 Hadoop 的思想之源(Google 在大数据方面的三篇论文):

- GFS —> HDFS

- MapReduce —> MR

- BigTable —> HBase

2003 - 2004 年,Google 公开了部分 GFS 和 MapReduce 思想的细节,以此为基础,Doug Cutting 等人用了 2 年业余时间实现了 DFS 和 MapReduce 机制,使 Nutch 性能飙升。

2005 年,Hadoop 作为 Lucene 的子项目 Nutch 的一部分正式引入 Apache 基金会。

2006 年 3 月份,MapReduce 和 Nutch Distributed File System(NDFS)分别被纳入到 Hadoop 项目中,Hadoop 就此正式诞生,标志着大数据时代来临。

名字来源于 Doug Cutting 儿子的玩具大象:

Hadoop 三大发行版本

- Hadoop 三大发行版本:Apache、Cloudera、Hortonworks。

- Apache 版本是最原始(最基础)的版本,对于入门学习最好。— 2006 年

- Cloudera 内部集成了很多大数据框架,对应产品 CDH。— 2008 年

- Hortonworks 文档较好,对应产品 HDP。— 2011 年

- Hortonworks 现在已经被 Cloudera 公司收购,推出新的品牌 CDP。

Apache Hadoop

Cloudera Hadoop

- 官网地址:https://www.cloudera.com/downloads/cdh

- 下载地址:https://docs.cloudera.com/documentation/enterprise/6/release-notes/topics/rg_cdh_6_download.html

Hortonworks Hadoop

- 官网地址:https://hortonworks.com/products/data-center/hdp/

- 下载地址:https://hortonworks.com/downloads/#data-platform

Hadoop 优势

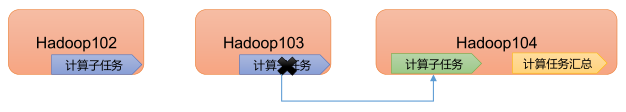

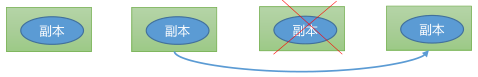

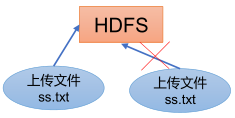

高可靠性:Hadoop 底层维护多个数据副本,所以即使 Hadoop 某个计算元素或存储出现故障,也不会导致数据的丢失。

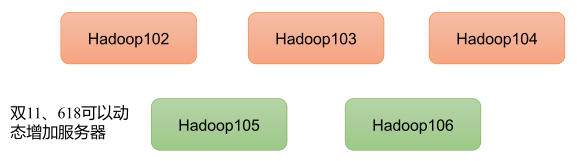

高扩展性:在集群间分配任务数据,可方便的扩展数以千计的节点。

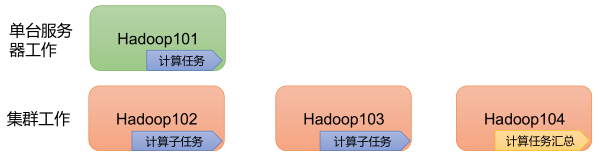

高效性:在 MapReduce 的思想下,Hadoop 是并行工作的,以加快任务处理速度。

高容错性:能够自动将失败的任务重新分配。

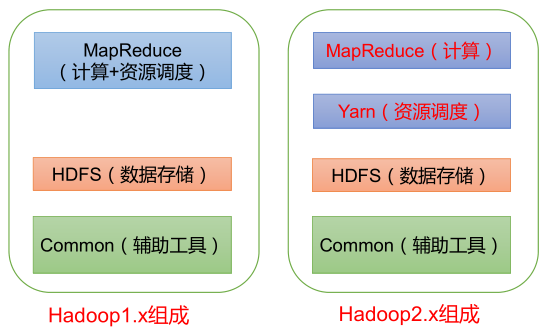

Hadoop 组成

- Hadoop 1.x 时 代 ,Hadoop 中的 MapReduce 同时处理业务逻辑运算和资源的调度,耦合性较大。

- Hadoop 2.x 时代,增加了 Yarn。Yarn 只负责资源的调度,MapReduce 只负责运算。

- Hadoop 3.x 时代,在组成上没有变化。

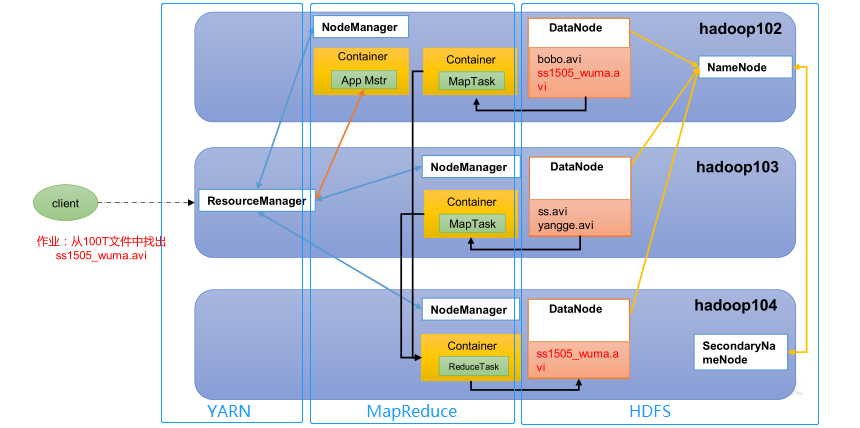

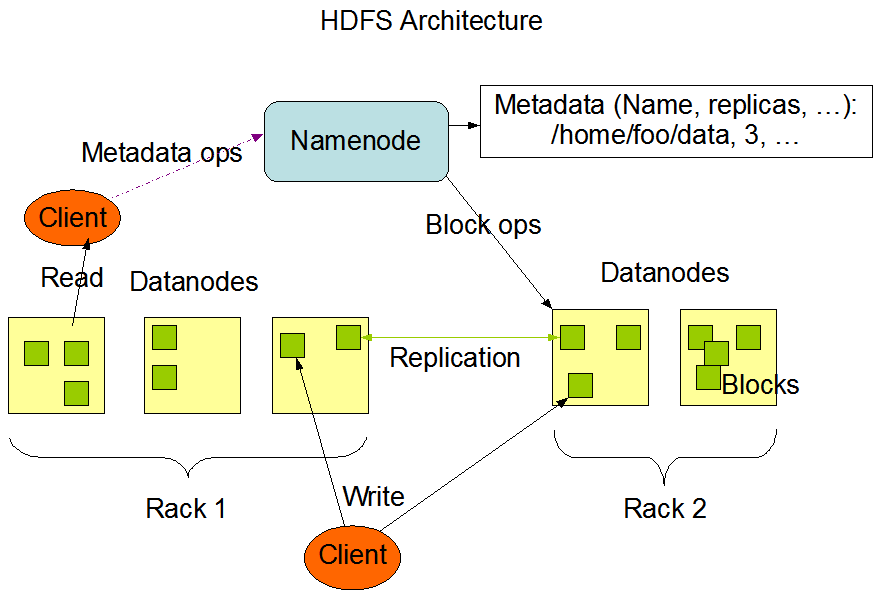

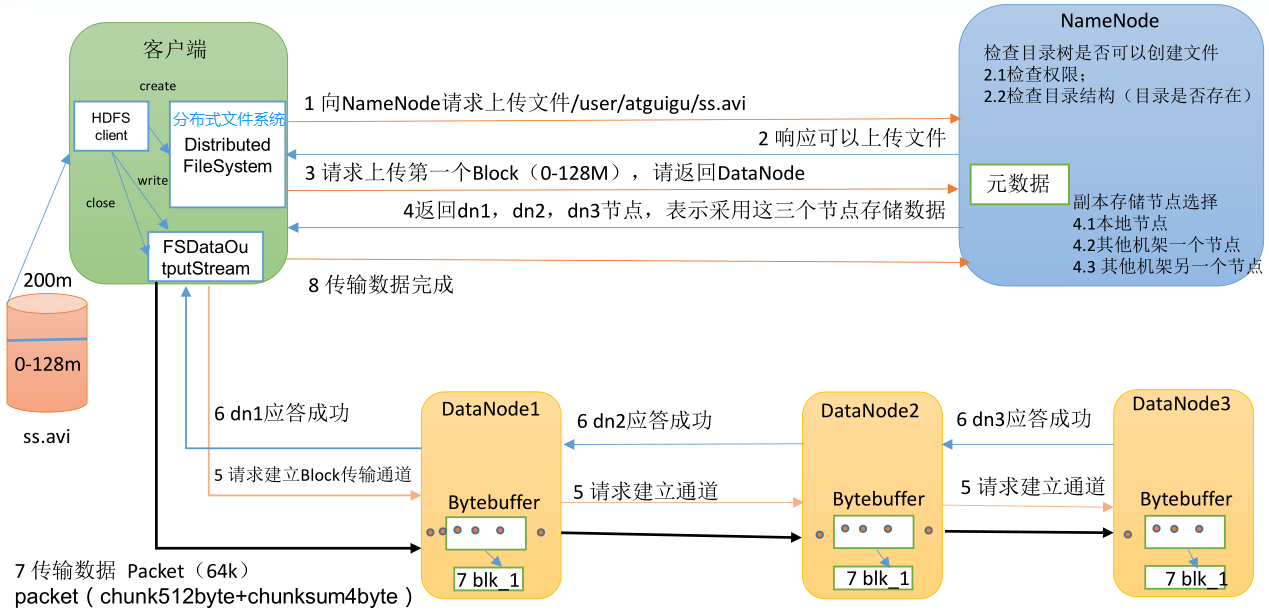

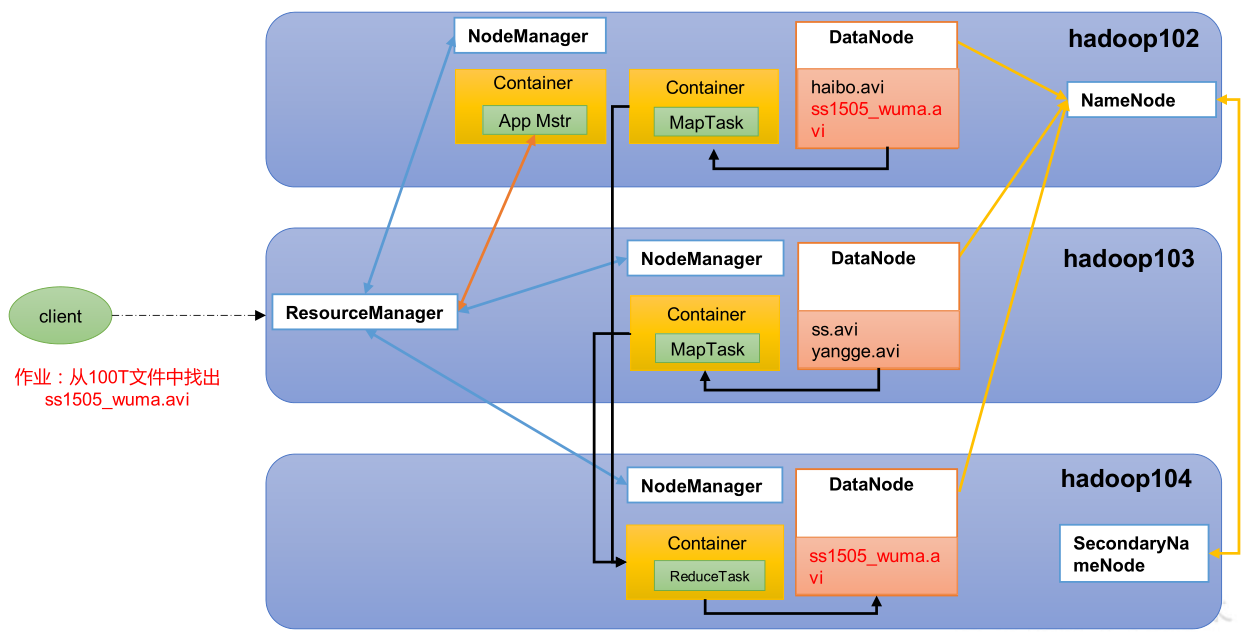

HDFS 架构概述

- Hadoop Distributed File System,简称 HDFS,是一个分布式文件系统。包含三个模块:

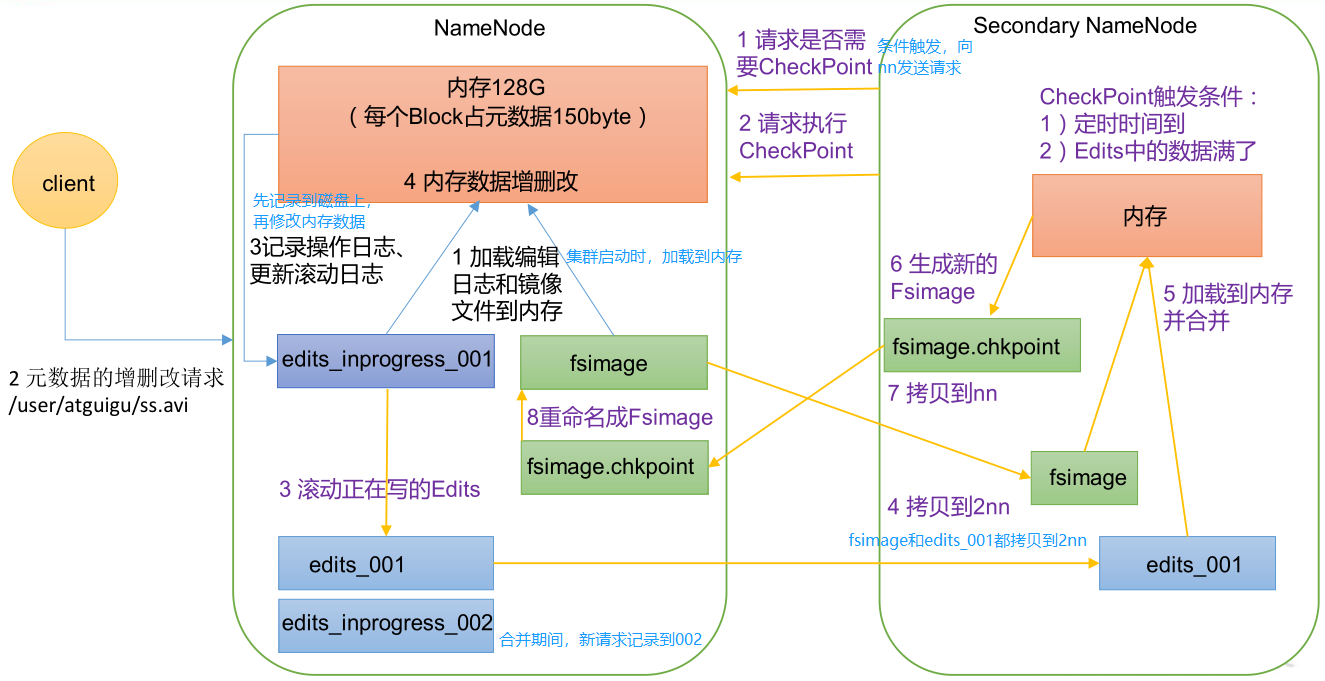

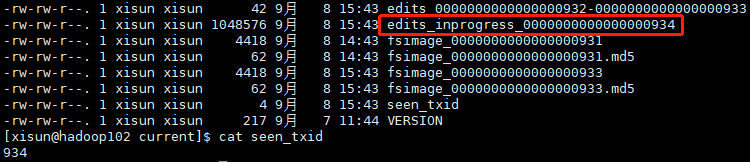

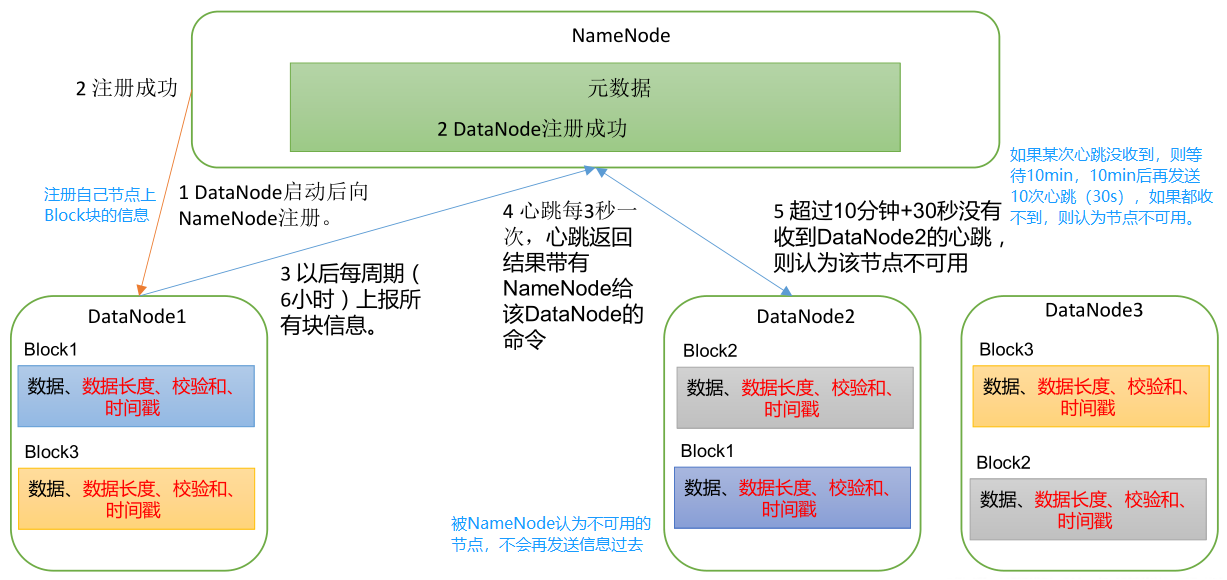

- NameNode:简称 nn,存储文件的元数据,如文件名,文件目录结构,文件属性(生成时间、副本数、文件权限),以及每个文件的块列表和块所在的 DataNode 等。

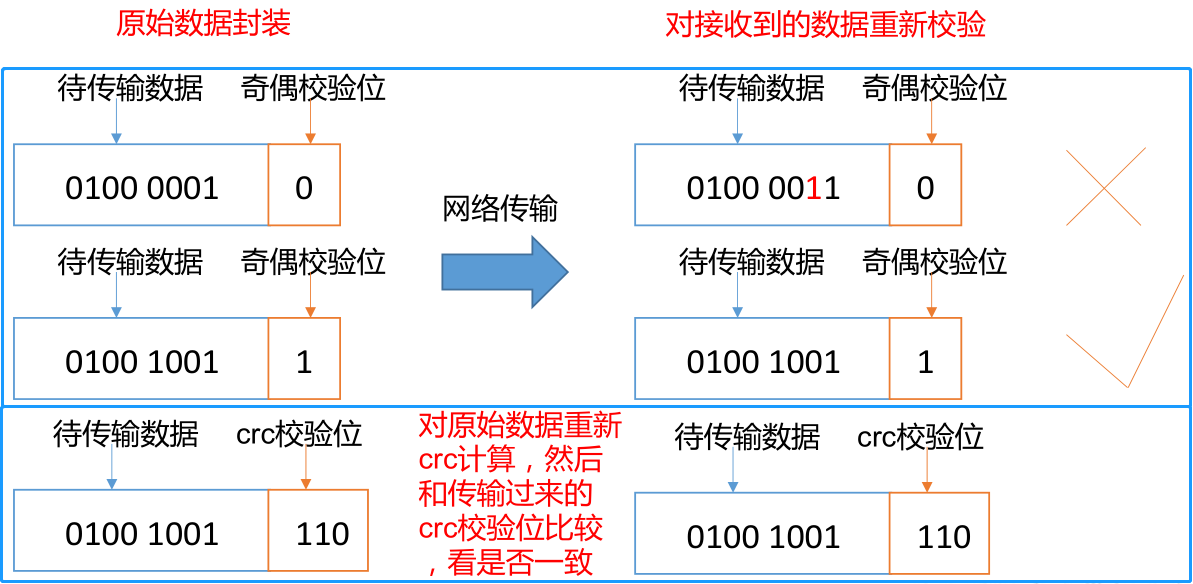

- DataNode:简称 dn,在本地文件系统存储文件块数据,以及块数据的校验和。

- Secondary NameNode:简称 2nn,每隔一段时间对 NameNode 元数据备份。

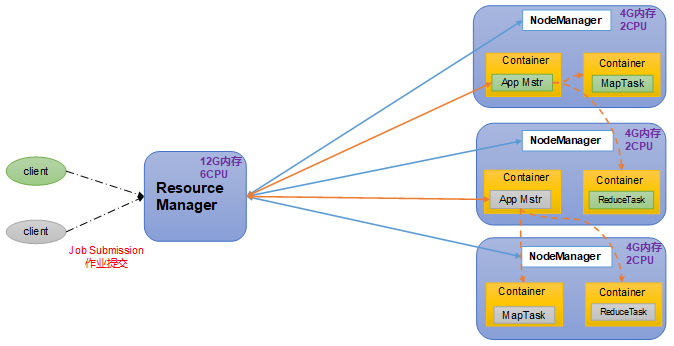

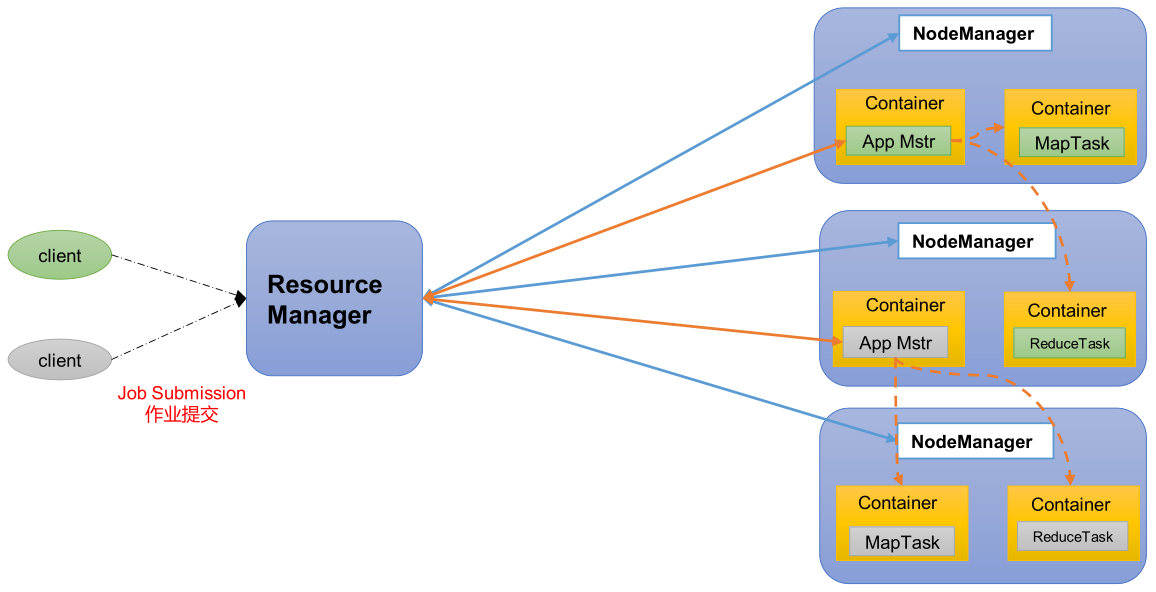

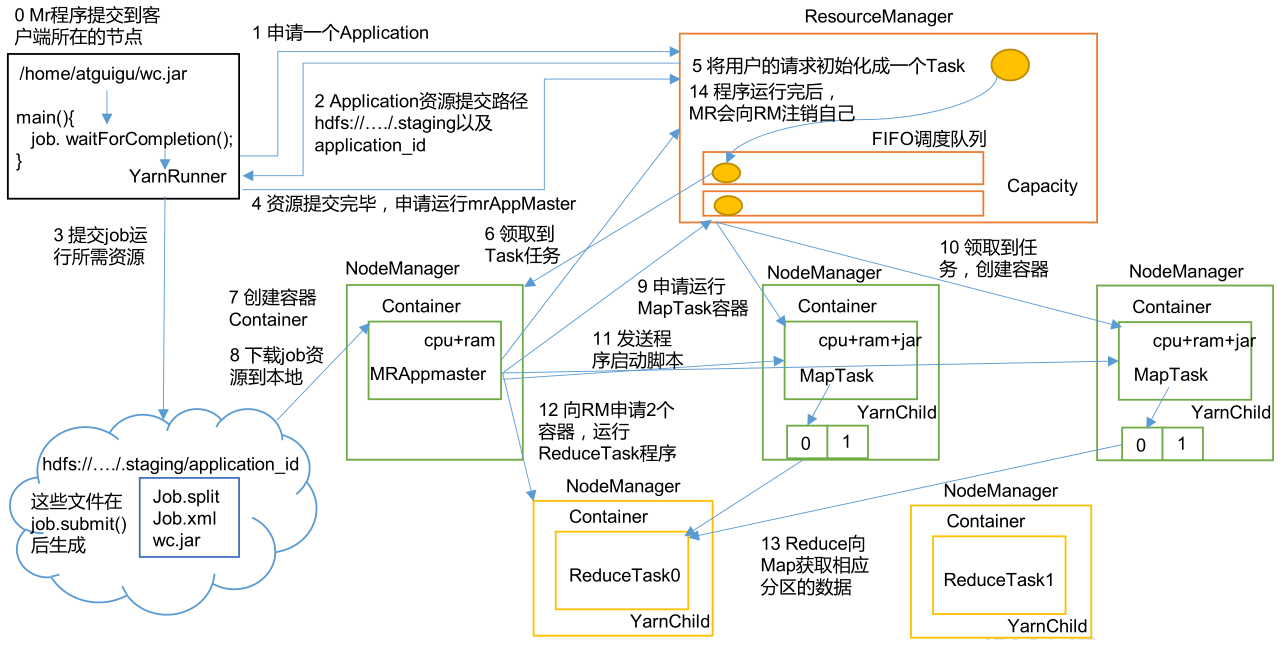

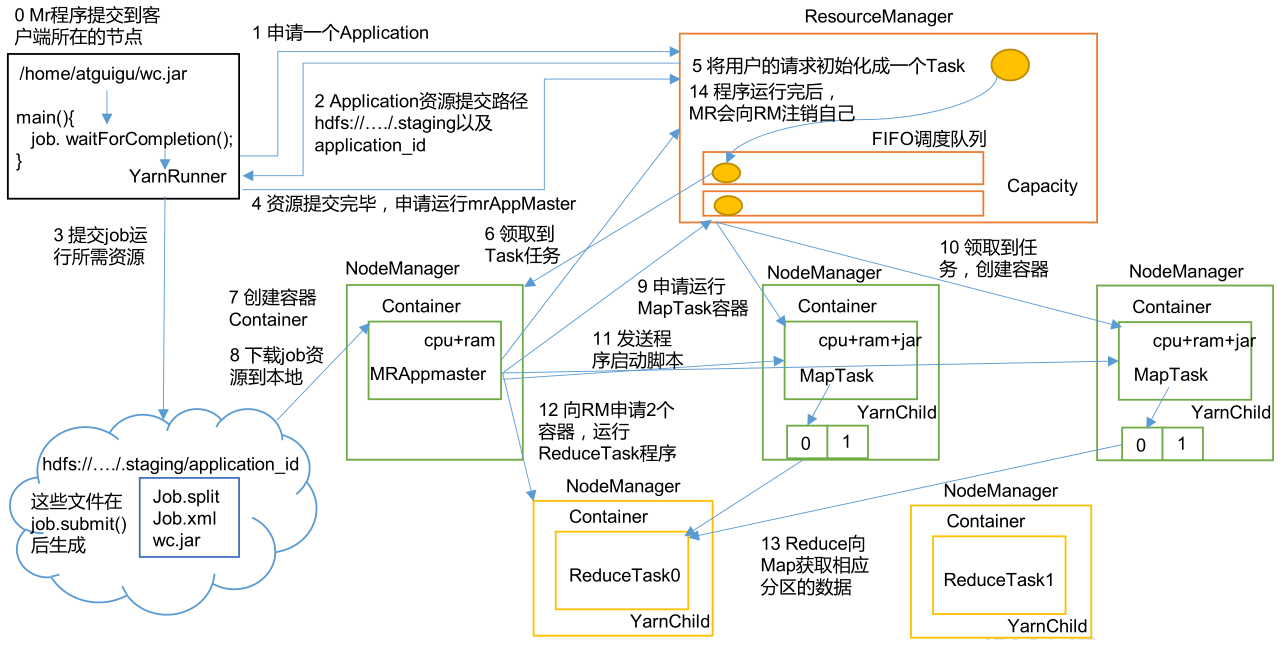

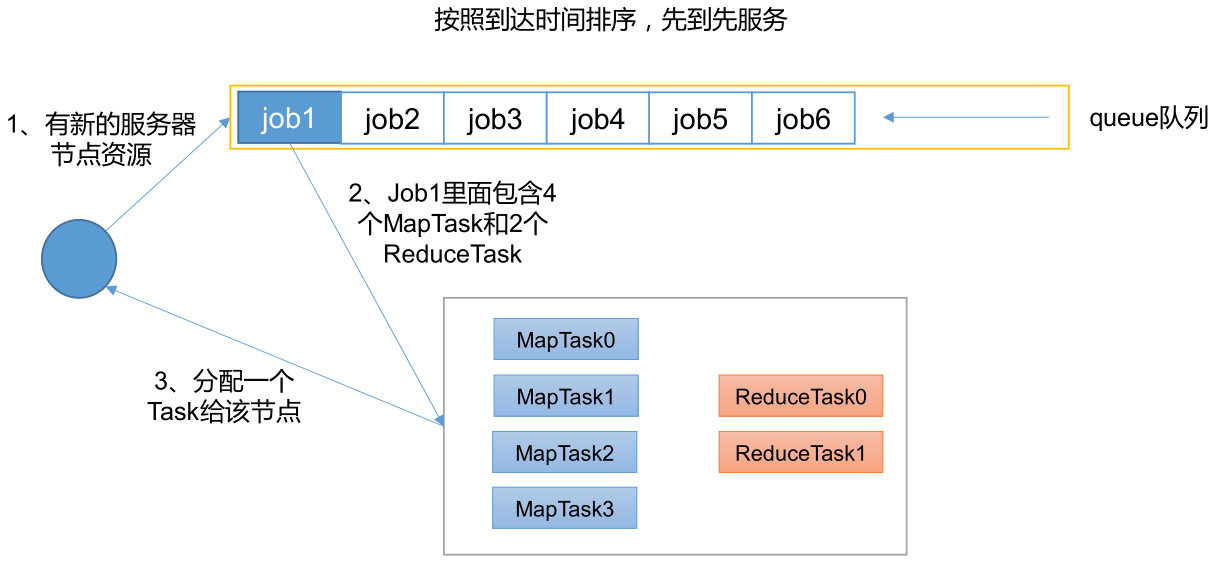

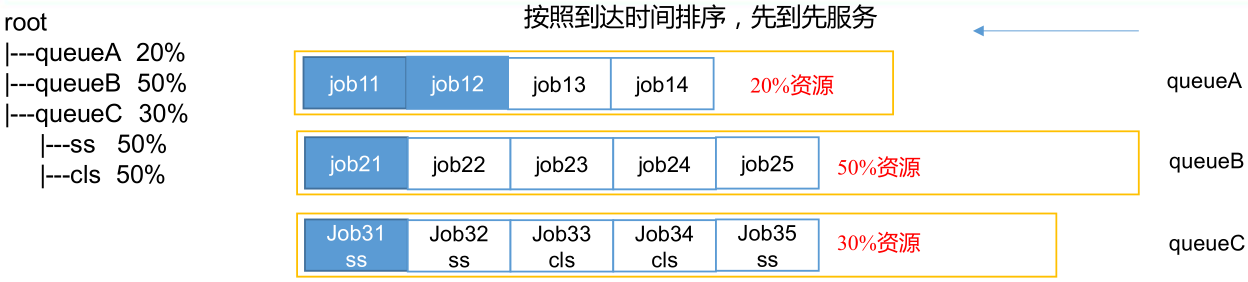

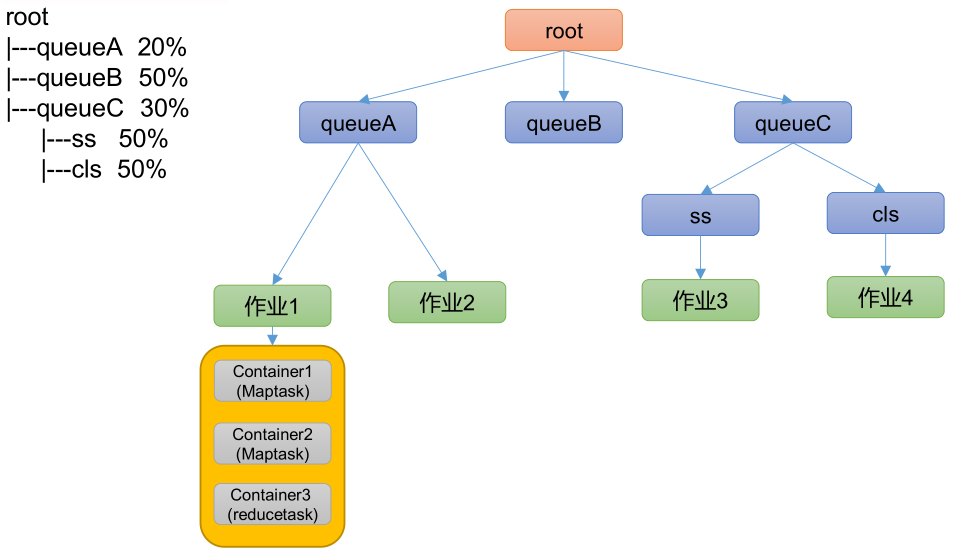

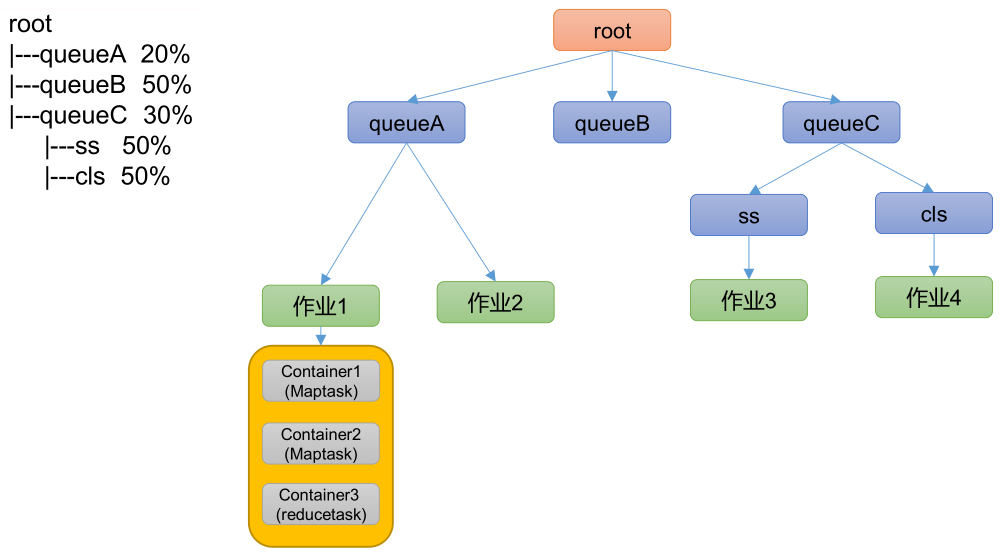

YARN 架构概述

Yet Another Resource Negotiator,简称 YARN ,另一种资源协调者,是 Hadoop 的资源管理器。有两大组件:

- ResourceManager:简称 RM,整个集群资源(内存、CPU 等)的管理者。

- NodeManager:简称 NM,单个节点服务器资源的管理者。每个 NodeManager 上可以有多个 Container。

- Container:容器,相当于一台独立的服务器,里面封装了任务运行所需要的资源,如内存、CPU、磁盘、网络等。

- ApplicationMaster:简称 AM,单个任务运行的管理者。

客户端 client 可以有多个。

集群上可以运行多个 ApplicationMaster。

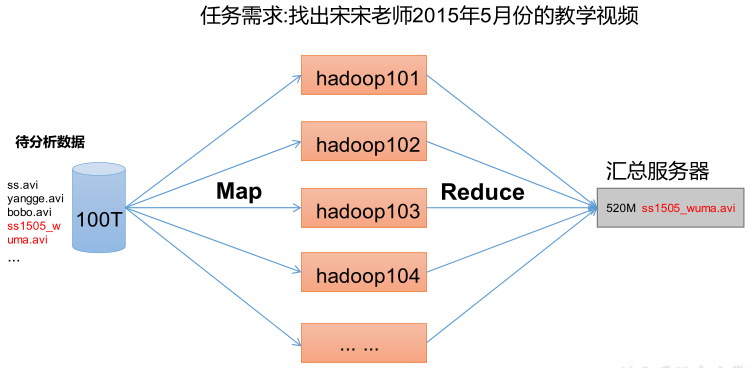

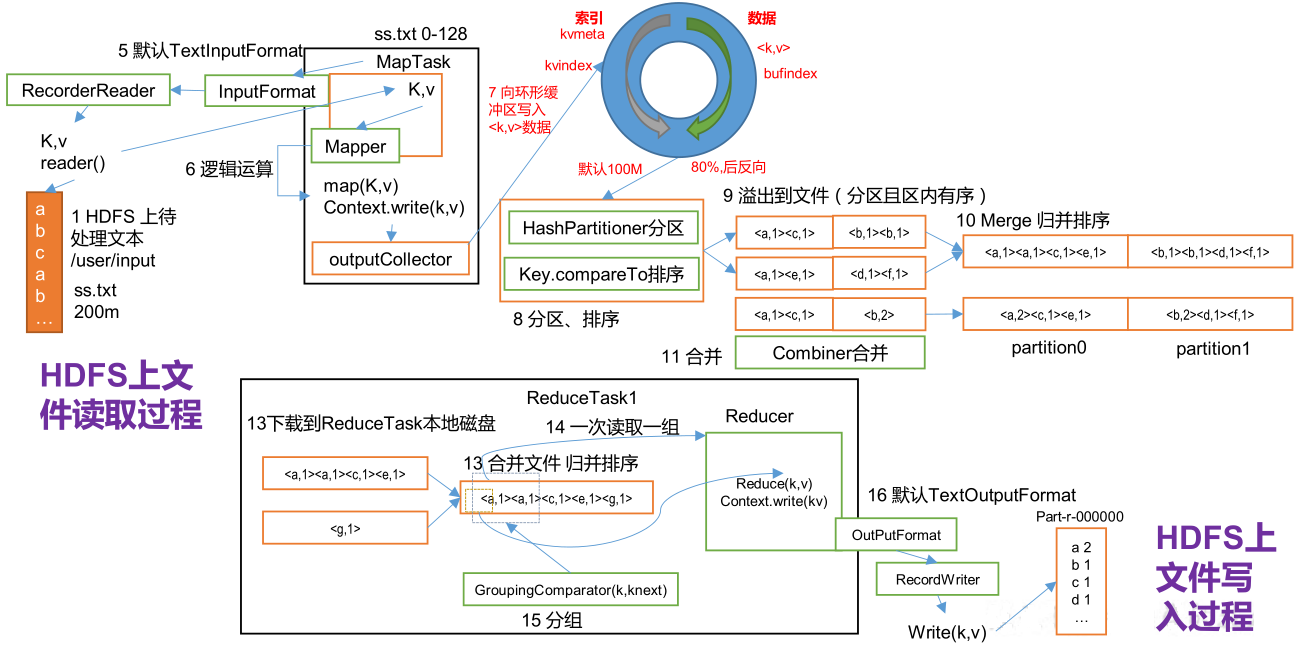

MapReduce 架构概述

MapReduce 将计算过程分为两个阶段:Map 和 Reduce。

- Map 阶段并行处理输入数据。

- Reduce 阶段对 Map 结果进行汇总。

HDFS 、YARN 、MapReduce 三者关系

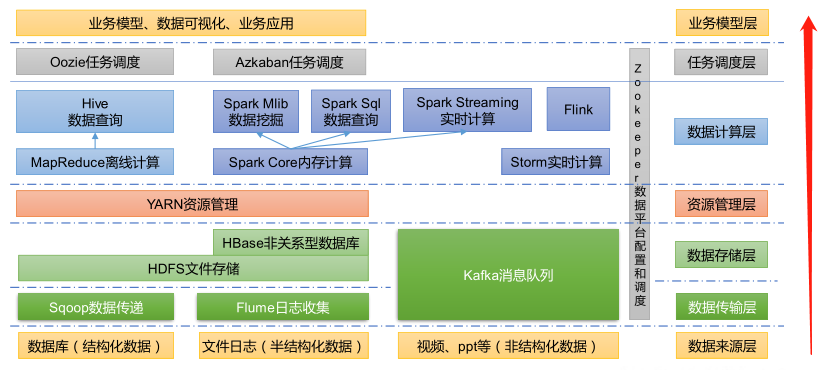

大数据技术生态体系

- Sqoop:Sqoop 是一款开源的工具,主要用于在 Hadoop、Hive 与传统的数据库(MySQL)间进行数据的传递,可以将一个关系型数据库(例如:MySQL,Oracle 等)中的数据导进到 Hadoop 的 HDFS 中,也可以将 HDFS 的数据导进到关系型数据库中。

- Flume:Flume 是一个高可用的,高可靠的,分布式的海量日志采集、聚合和传输的系统,Flume 支持在日志系统中定制各类数据发送方,用于收集数据。

- Kafka:Kafka 是一种高吞吐量的分布式发布订阅消息系统。

- Spark:Spark 是当前最流行的开源大数据内存计算框架。可以基于 Hadoop 上存储的大数据进行计算。

- Flink:Flink 是当前最流行的开源大数据内存计算框架。用于实时计算的场景较多。

- Oozie:Oozie 是一个管理 Hadoop 作业(job)的工作流程调度管理系统。

- Hbase:HBase 是一个分布式的、面向列的开源数据库。HBase 不同于一般的关系数据库,它是一个适合于非结构化数据存储的数据库。

- Hive:Hive 是基于 Hadoop 的一个数据仓库工具,可以将结构化的数据文件映射为一张数据库表,并提供简单的 SQL 查询功能,可以将 SQL 语句转换为 MapReduce 任务进行运行。其优点是学习成本低,可以通过类 SQL 语句快速实现简单的 MapReduce 统计,不必开发专门的 MapReduce 应用,十分适合数据仓库的统计分析。

- ZooKeeper:它是一个针对大型分布式系统的可靠协调系统,提供的功能包括:配置维护、名字服务、分布式同步、组服务等。

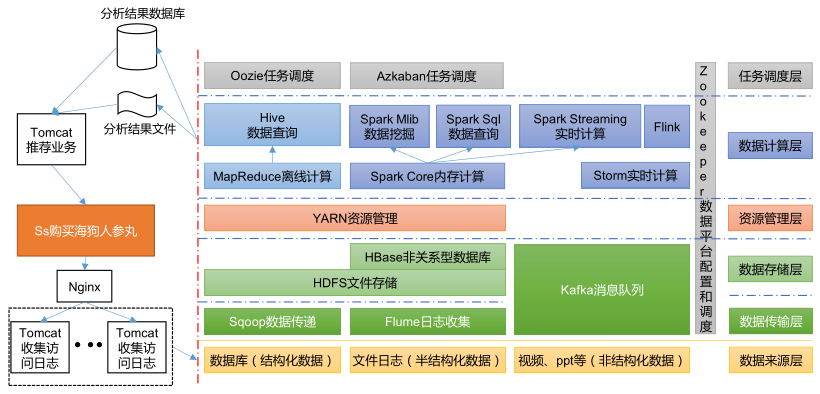

推荐系统框架图

Hadoop 运行环境搭建

模板虚拟机环境准备

安装模板虚拟机,IP 地址 192.168.10.100、主机名称 hadoop100、内存 2 G、硬盘 50 G。

- 主机名称不要起 hadoop,hadoop000 等特殊名称。

开启虚拟机,切换到 root 用户操作下面得命令:

1

2[xisun@hadoop100 ~]$ su root

密码:确保虚拟机可以正常上网:

1

2

3

4

5

6

7

8

9

10[root@hadoop100 xisun]# ping www.baidu.com

PING www.a.shifen.com (14.215.177.39) 56(84) bytes of data.

64 bytes from 14.215.177.39 (14.215.177.39): icmp_seq=1 ttl=128 time=41.0 ms

64 bytes from 14.215.177.39 (14.215.177.39): icmp_seq=2 ttl=128 time=40.9 ms

64 bytes from 14.215.177.39 (14.215.177.39): icmp_seq=3 ttl=128 time=41.3 ms

64 bytes from 14.215.177.39 (14.215.177.39): icmp_seq=4 ttl=128 time=42.5 ms

^C

--- www.a.shifen.com ping statistics ---

4 packets transmitted, 4 received, 0% packet loss, time 3007ms

rtt min/avg/max/mdev = 40.987/41.495/42.582/0.674 ms安装 epel-release:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49[root@hadoop100 xisun]# yum install -y epel-release

已加载插件:fastestmirror, langpacks

Loading mirror speeds from cached hostfile

* base: mirrors.njupt.edu.cn

* extras: mirrors.njupt.edu.cn

* updates: mirrors.njupt.edu.cn

base | 3.6 kB 00:00:00

extras | 2.9 kB 00:00:00

updates | 2.9 kB 00:00:00

正在解决依赖关系

--> 正在检查事务

---> 软件包 epel-release.noarch.0.7-11 将被 安装

--> 解决依赖关系完成

依赖关系解决

===================================================================================================================================================================================================================

Package 架构 版本 源 大小

===================================================================================================================================================================================================================

正在安装:

epel-release noarch 7-11 extras 15 k

事务概要

===================================================================================================================================================================================================================

安装 1 软件包

总下载量:15 k

安装大小:24 k

Downloading packages:

警告:/var/cache/yum/x86_64/7/extras/packages/epel-release-7-11.noarch.rpm: 头V3 RSA/SHA256 Signature, 密钥 ID f4a80eb5: NOKEY

epel-release-7-11.noarch.rpm 的公钥尚未安装

epel-release-7-11.noarch.rpm | 15 kB 00:00:00

从 file:///etc/pki/rpm-gpg/RPM-GPG-KEY-CentOS-7 检索密钥

导入 GPG key 0xF4A80EB5:

用户ID : "CentOS-7 Key (CentOS 7 Official Signing Key) <security@centos.org>"

指纹 : 6341 ab27 53d7 8a78 a7c2 7bb1 24c6 a8a7 f4a8 0eb5

软件包 : centos-release-7-8.2003.0.el7.centos.x86_64 (@anaconda)

来自 : /etc/pki/rpm-gpg/RPM-GPG-KEY-CentOS-7

Running transaction check

Running transaction test

Transaction test succeeded

Running transaction

正在安装 : epel-release-7-11.noarch 1/1

验证中 : epel-release-7-11.noarch 1/1

已安装:

epel-release.noarch 0:7-11

完毕!Extra Packages for Enterprise Linux 是为“红帽系”的操作系统提供额外的软件包,适用于 RHEL、CentOS 和 Scientific Linux。相当于是一个软件仓库,大多数 rpm 包在官方 repository 中是找不到的。

如果 Linux 安装的是最小系统版,还需要安装如下工具,如果安装的是 Linux 桌面标准版,不需要执行如下操作(本机安装的是桌面版):

net-tool:工具包集合,包含 ifconfig 等命令。

1

[root@hadoop100 xisun]# yum install -y net-tools

vim:编辑器。

1

[root@hadoop100 xisun]# yum install -y vim

关闭防火墙,关闭防火墙开机自启:

查看防火墙状态:

1

2[root@hadoop100 xisun]# firewall-cmd --state

running关闭防火墙:

1

2

3[root@hadoop100 xisun]# systemctl stop firewalld.service

[root@hadoop100 xisun]# firewall-cmd --state

not running关闭防火墙开机自启:

1

2

3[root@hadoop100 xisun]# systemctl disable firewalld.service

Removed symlink /etc/systemd/system/multi-user.target.wants/firewalld.service.

Removed symlink /etc/systemd/system/dbus-org.fedoraproject.FirewallD1.service.在企业开发时,通常单个服务器的防火墙是关闭的,公司整体对外访问时会设置非常安全的防火墙。

创建新用户,并修改新用户的密码(可省略):

1

2[root@hadoop100 xisun]# useradd xisun

[root@hadoop100 xisun]# passwd xisun- 生产环境下,应避免使用 root 用户直接操作。

配置刚创建的新用户具有 root 权限,方便后期加 sudo 执行 root 权限的命令:

1

[root@hadoop100 xisun]# vim /etc/sudoers

修改

/etc/sudoers文件,在 %wheel 这行下面添加一行,将新用户 xisun 设置为免密使用 root 权限,如下所示:1

2

3

4

5

6

7

8

9

10

11## Allow root to run any commands anywhere

root ALL=(ALL) ALL

## Allows members of the 'sys' group to run networking, software,

## service management apps and more.

# %sys ALL = NETWORKING, SOFTWARE, SERVICES, STORAGE, DELEGATING, PROCESSES, LOCATE, DRIVERS

## Allows people in group wheel to run all commands

%wheel ALL=(ALL) ALL

xisun ALL=(ALL) NOPASSWD:ALL- xisun 这一行不要直接放到 root 行下面,因为所有用户都属于 wheel 组,如果放在 root 行下面,则是先配置了 xisun 用户在使用 sudo 命令时具有免输入密码功能,但是程序执行到 %wheel 行时,该功能又会被覆盖回需要密码。所以 xisun 这一行要放到 %wheel 这行下面。

从 root 用户退回到 xisun 用户:

1

2[root@hadoop100 xisun]# exit

exit在

/opt目录下创建文件夹:1

2

3

4

5

6

7

8

9

10

11

12

13[xisun@hadoop100 ~]$ cd /opt/

[xisun@hadoop100 opt]$ sudo mkdir module

[xisun@hadoop100 opt]$ sudo mkdir software

[xisun@hadoop100 opt]$ ll

总用量 0

drwxr-xr-x. 2 root root 6 8月 30 22:08 module

drwxr-xr-x. 2 root root 6 10月 31 2018 rh

drwxr-xr-x. 2 root root 6 8月 30 22:09 software

[xisun@hadoop100 opt]$ sudo rm -r rh

[xisun@hadoop100 opt]$ ll

总用量 0

drwxr-xr-x. 2 root root 6 8月 30 22:08 module

drwxr-xr-x. 2 root root 6 8月 30 22:09 software/opt目录下,需要使用 sudo 命令才能创建和删除文件夹:1

2[xisun@hadoop100 opt]$ mkdir test

mkdir: 无法创建目录"test": 权限不够

修改创建的文件夹所属主和所属组为 xisun 用户:

1

2

3

4

5

6

7

8

9

10[xisun@hadoop100 opt]$ ll

总用量 0

drwxr-xr-x. 2 root root 6 8月 30 22:08 module

drwxr-xr-x. 2 root root 6 8月 30 22:09 software

[xisun@hadoop100 opt]$ sudo chown xisun:xisun module/

[xisun@hadoop100 opt]$ sudo chown xisun:xisun software/

[xisun@hadoop100 opt]$ ll

总用量 0

drwxr-xr-x. 2 xisun xisun 6 8月 30 22:08 module

drwxr-xr-x. 2 xisun xisun 6 8月 30 22:09 software卸载虚拟机自带的 JDK,以 root 用户执行:

1

2

3

4

5

6

7

8

9

10

11

12[xisun@hadoop100 opt]$ su root

密码:

[root@hadoop100 opt]# rpm -qa | grep -i java

javapackages-tools-3.4.1-11.el7.noarch

tzdata-java-2019c-1.el7.noarch

java-1.8.0-openjdk-headless-1.8.0.242.b08-1.el7.x86_64

java-1.8.0-openjdk-1.8.0.242.b08-1.el7.x86_64

java-1.7.0-openjdk-headless-1.7.0.251-2.6.21.1.el7.x86_64

python-javapackages-3.4.1-11.el7.noarch

java-1.7.0-openjdk-1.7.0.251-2.6.21.1.el7.x86_64

[root@hadoop100 opt]# rpm -qa | grep -i java | xargs -n1 rpm -e --nodeps

[root@hadoop100 opt]# rpm -qa | grep -i java- 如果你的虚拟机是最小化安装不需要执行这一步。

rpm -qa:查询所安装的所有 rpm 软件包。grep -i:忽略大小写。xargs -n1:表示每次只传递一个参数。rpm -e –nodeps:强制卸载软件。

重启虚拟机:

1

[root@hadoop100 opt]# reboot

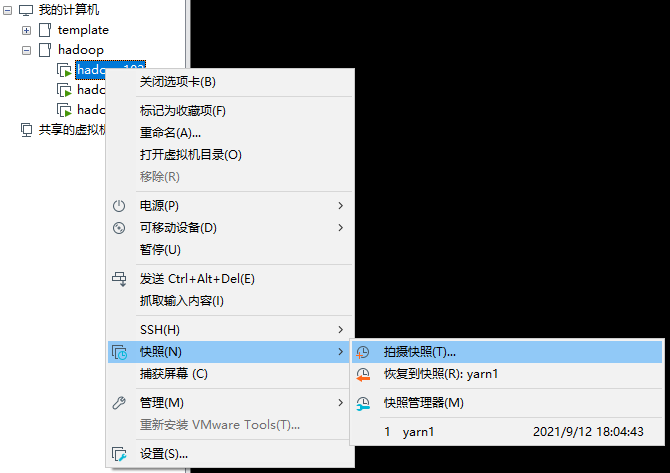

克隆虚拟机

利用模板机 hadoop100,克隆三台虚拟机:hadoop102,hadoop103,hadoop104。

- 注意:克隆时,要先关闭 hadoop100。

修改克隆机的 IP 地址和主机名,以 hadoop102 为例,进行说明:

开启 hadoop102,以 root 账户登录。

修改 IP 地址:

1

[root@hadoop100 ~]# vim /etc/sysconfig/network-scripts/ifcfg-ens33

修改 ifcfg-ens33 文件中的 IPADDR:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19TYPE="Ethernet"

PROXY_METHOD="none"

BROWSER_ONLY="no"

BOOTPROTO="static"

DEFROUTE="yes"

IPV4_FAILURE_FATAL="no"

IPV6INIT="yes"

IPV6_AUTOCONF="yes"

IPV6_DEFROUTE="yes"

IPV6_FAILURE_FATAL="no"

IPV6_ADDR_GEN_MODE="stable-privacy"

NAME="ens33"

UUID="eb503f88-96af-455d-b8f9-dbda02ca79d4"

DEVICE="ens33"

ONBOOT="yes"

IPADDR=192.168.10.102 # 修改IP地址为192.168.10.102

GATEWAY=192.168.10.2

DNS1=192.168.10.2

修改主机名:

1

[root@hadoop100 ~]# vim /etc/hostname

1

hadoop102

重启:

1

[root@hadoop100 ~]# reboot

验证 IP 地址和主机名,以及网络是否正常:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40[root@hadoop102 ~]# ifconfig

ens33: flags=4163<UP,BROADCAST,RUNNING,MULTICAST> mtu 1500

inet 192.168.10.102 netmask 255.255.255.0 broadcast 192.168.10.255

inet6 fe80::ac1e:7fe1:a566:2670 prefixlen 64 scopeid 0x20<link>

ether 00:0c:29:c5:1d:96 txqueuelen 1000 (Ethernet)

RX packets 1025 bytes 878131 (857.5 KiB)

RX errors 0 dropped 0 overruns 0 frame 0

TX packets 442 bytes 35254 (34.4 KiB)

TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0

lo: flags=73<UP,LOOPBACK,RUNNING> mtu 65536

inet 127.0.0.1 netmask 255.0.0.0

inet6 ::1 prefixlen 128 scopeid 0x10<host>

loop txqueuelen 1000 (Local Loopback)

RX packets 48 bytes 4080 (3.9 KiB)

RX errors 0 dropped 0 overruns 0 frame 0

TX packets 48 bytes 4080 (3.9 KiB)

TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0

virbr0: flags=4099<UP,BROADCAST,MULTICAST> mtu 1500

inet 192.168.122.1 netmask 255.255.255.0 broadcast 192.168.122.255

ether 52:54:00:97:ed:a7 txqueuelen 1000 (Ethernet)

RX packets 0 bytes 0 (0.0 B)

RX errors 0 dropped 0 overruns 0 frame 0

TX packets 0 bytes 0 (0.0 B)

TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0

[root@hadoop102 ~]# hostname

hadoop102

[root@hadoop102 ~]# ping www.baidu.com

PING www.a.shifen.com (14.215.177.39) 56(84) bytes of data.

64 bytes from 14.215.177.39 (14.215.177.39): icmp_seq=1 ttl=128 time=42.9 ms

64 bytes from 14.215.177.39 (14.215.177.39): icmp_seq=2 ttl=128 time=42.6 ms

64 bytes from 14.215.177.39 (14.215.177.39): icmp_seq=3 ttl=128 time=42.7 ms

64 bytes from 14.215.177.39 (14.215.177.39): icmp_seq=4 ttl=128 time=42.8 ms

64 bytes from 14.215.177.39 (14.215.177.39): icmp_seq=5 ttl=128 time=42.8 ms

^C

--- www.a.shifen.com ping statistics ---

5 packets transmitted, 5 received, 0% packet loss, time 4012ms

rtt min/avg/max/mdev = 42.689/42.814/42.930/0.276 ms按照相同的步骤,修改 hadoop103 的 IP 地址为 192.168.10.103,主机名为 hadoop103,hadoop104 的 IP 地址为 192.168.10.104,主机名为 hadoop104,并验证。

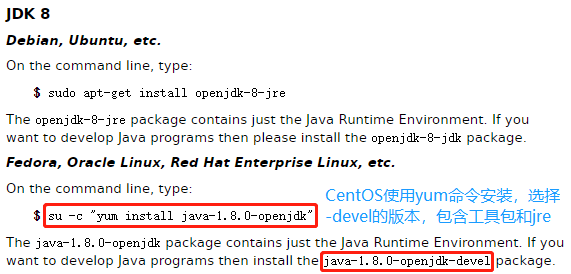

安装 JDK

下面步骤以 hadoop102 为例,进行说明。

安装 JDK 前,一定确保提前删除了虚拟机自带的 JDK,此步骤在前面已执行。

1

[xisun@hadoop102 ~]$ rpm -qa | grep -i java

1

[xisun@hadoop100 ~]$ rpm -qa | grep -i java | xargs -n1 sudo rpm -e --nodeps

1

2[xisun@hadoop102 ~]$ java -version

bash: java: 未找到命令...安装 OpenJDK 8。

下载地址:https://openjdk.java.net/,https://openjdk.java.net/install/index.html

使用 root 权限,以命令行安装:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91[xisun@hadoop102 ~]$ sudo yum install -y java-1.8.0-openjdk-devel

已加载插件:fastestmirror, langpacks

Loading mirror speeds from cached hostfile

* base: mirrors.cqu.edu.cn

* epel: mirror.sjtu.edu.cn

* extras: mirrors.cn99.com

* updates: mirrors.cn99.com

正在解决依赖关系

--> 正在检查事务

---> 软件包 java-1.8.0-openjdk-devel.x86_64.1.1.8.0.302.b08-0.el7_9 将被 安装

--> 正在处理依赖关系 java-1.8.0-openjdk(x86-64) = 1:1.8.0.302.b08-0.el7_9,它被软件包 1:java-1.8.0-openjdk-devel-1.8.0.302.b08-0.el7_9.x86_64 需要

--> 正在处理依赖关系 libjvm.so()(64bit),它被软件包 1:java-1.8.0-openjdk-devel-1.8.0.302.b08-0.el7_9.x86_64 需要

--> 正在处理依赖关系 libjava.so()(64bit),它被软件包 1:java-1.8.0-openjdk-devel-1.8.0.302.b08-0.el7_9.x86_64 需要

--> 正在检查事务

---> 软件包 java-1.8.0-openjdk.x86_64.1.1.8.0.302.b08-0.el7_9 将被 安装

---> 软件包 java-1.8.0-openjdk-headless.x86_64.1.1.8.0.302.b08-0.el7_9 将被 安装

--> 正在处理依赖关系 tzdata-java >= 2021a,它被软件包 1:java-1.8.0-openjdk-headless-1.8.0.302.b08-0.el7_9.x86_64 需要

--> 正在处理依赖关系 jpackage-utils,它被软件包 1:java-1.8.0-openjdk-headless-1.8.0.302.b08-0.el7_9.x86_64 需要

--> 正在检查事务

---> 软件包 javapackages-tools.noarch.0.3.4.1-11.el7 将被 安装

--> 正在处理依赖关系 python-javapackages = 3.4.1-11.el7,它被软件包 javapackages-tools-3.4.1-11.el7.noarch 需要

---> 软件包 tzdata-java.noarch.0.2021a-1.el7 将被 安装

--> 正在检查事务

---> 软件包 python-javapackages.noarch.0.3.4.1-11.el7 将被 安装

--> 解决依赖关系完成

依赖关系解决

===================================================================================================================================================================================================================

Package 架构 版本 源 大小

===================================================================================================================================================================================================================

正在安装:

java-1.8.0-openjdk-devel x86_64 1:1.8.0.302.b08-0.el7_9 updates 9.8 M

为依赖而安装:

java-1.8.0-openjdk x86_64 1:1.8.0.302.b08-0.el7_9 updates 311 k

java-1.8.0-openjdk-headless x86_64 1:1.8.0.302.b08-0.el7_9 updates 33 M

javapackages-tools noarch 3.4.1-11.el7 base 73 k

python-javapackages noarch 3.4.1-11.el7 base 31 k

tzdata-java noarch 2021a-1.el7 updates 191 k

事务概要

===================================================================================================================================================================================================================

安装 1 软件包 (+5 依赖软件包)

总下载量:43 M

安装大小:152 M

Downloading packages:

(1/6): python-javapackages-3.4.1-11.el7.noarch.rpm | 31 kB 00:00:00

(2/6): java-1.8.0-openjdk-1.8.0.302.b08-0.el7_9.x86_64.rpm | 311 kB 00:00:00

(3/6): javapackages-tools-3.4.1-11.el7.noarch.rpm | 73 kB 00:00:00

(4/6): tzdata-java-2021a-1.el7.noarch.rpm | 191 kB 00:00:01

(5/6): java-1.8.0-openjdk-headless-1.8.0.302.b08-0.el7_9.x86_64.rpm | 33 MB 00:00:07

(6/6): java-1.8.0-openjdk-devel-1.8.0.302.b08-0.el7_9.x86_64.rpm | 9.8 MB 00:00:13

-------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------

总计 3.1 MB/s | 43 MB 00:00:13

Running transaction check

Running transaction test

Transaction test succeeded

Running transaction

警告:RPM 数据库已被非 yum 程序修改。

** 发现 9 个已存在的 RPM 数据库问题, 'yum check' 输出如下:

icedtea-web-1.7.1-2.el7_6.x86_64 有缺少的需求 java-1.8.0-openjdk

icedtea-web-1.7.1-2.el7_6.x86_64 有缺少的需求 jpackage-utils

icedtea-web-1.7.1-2.el7_6.x86_64 有缺少的需求 jpackage-utils

jline-1.0-8.el7.noarch 有缺少的需求 java >= ('0', '1.5', None)

jline-1.0-8.el7.noarch 有缺少的需求 jpackage-utils

rhino-1.7R5-1.el7.noarch 有缺少的需求 jpackage-utils

rhino-1.7R5-1.el7.noarch 有缺少的需求 jpackage-utils

tagsoup-1.2.1-8.el7.noarch 有缺少的需求 jpackage-utils

tagsoup-1.2.1-8.el7.noarch 有缺少的需求 jpackage-utils >= ('0', '1.6', None)

正在安装 : tzdata-java-2021a-1.el7.noarch 1/6

正在安装 : python-javapackages-3.4.1-11.el7.noarch 2/6

正在安装 : javapackages-tools-3.4.1-11.el7.noarch 3/6

正在安装 : 1:java-1.8.0-openjdk-headless-1.8.0.302.b08-0.el7_9.x86_64 4/6

正在安装 : 1:java-1.8.0-openjdk-1.8.0.302.b08-0.el7_9.x86_64 5/6

正在安装 : 1:java-1.8.0-openjdk-devel-1.8.0.302.b08-0.el7_9.x86_64 6/6

验证中 : 1:java-1.8.0-openjdk-headless-1.8.0.302.b08-0.el7_9.x86_64 1/6

验证中 : python-javapackages-3.4.1-11.el7.noarch 2/6

验证中 : tzdata-java-2021a-1.el7.noarch 3/6

验证中 : 1:java-1.8.0-openjdk-devel-1.8.0.302.b08-0.el7_9.x86_64 4/6

验证中 : 1:java-1.8.0-openjdk-1.8.0.302.b08-0.el7_9.x86_64 5/6

验证中 : javapackages-tools-3.4.1-11.el7.noarch 6/6

已安装:

java-1.8.0-openjdk-devel.x86_64 1:1.8.0.302.b08-0.el7_9

作为依赖被安装:

java-1.8.0-openjdk.x86_64 1:1.8.0.302.b08-0.el7_9 java-1.8.0-openjdk-headless.x86_64 1:1.8.0.302.b08-0.el7_9 javapackages-tools.noarch 0:3.4.1-11.el7 python-javapackages.noarch 0:3.4.1-11.el7

tzdata-java.noarch 0:2021a-1.el7

完毕!公司生产环境使用的是 OpenJDK 8,此处保持一致。

验证 JDK 是否安装成功:

1

2

3

4[xisun@hadoop102 ~]$ java -version

openjdk version "1.8.0_302"

OpenJDK Runtime Environment (build 1.8.0_302-b08)

OpenJDK 64-Bit Server VM (build 25.302-b08, mixed mode)配置 JDK 环境变量:

查看 jre/bin 路径:

1

2[xisun@hadoop102 ~]$ dirname $(readlink $(readlink $(which java)))

/usr/lib/jvm/java-1.8.0-openjdk-1.8.0.302.b08-0.el7_9.x86_64/jre/bin新建

/etc/profile.d/my_env.sh文件,添加 Java 环境变量:1

[xisun@hadoop102 ~]$ sudo vim /etc/profile.d/my_env.sh

1

2

3# JAVA_HOME

export JAVA_HOME=/usr/lib/jvm/java-1.8.0-openjdk-1.8.0.302.b08-0.el7_9.x86_64

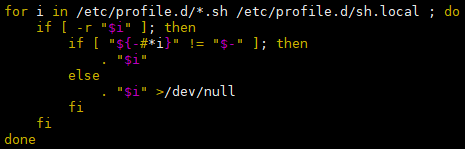

export PATH=$PATH:$JAVA_HOME/bin正常情况下,会将 Java 环境变量添加在

/etc/profile文件的最后,但该文件有如下设置,因此,可以在/etc/profile.d路径下自定义一个以 sh 结尾的文件,能达到同样的效果:

source 一下

/etc/profile文件,让新的环境变量 PATH 生效:1

[xisun@hadoop102 etc]$ source /etc/profile

查看配置是否生效:

1

2[xisun@hadoop102 etc]$ echo $JAVA_HOME

/usr/lib/jvm/java-1.8.0-openjdk-1.8.0.302.b08-0.el7_9.x86_64

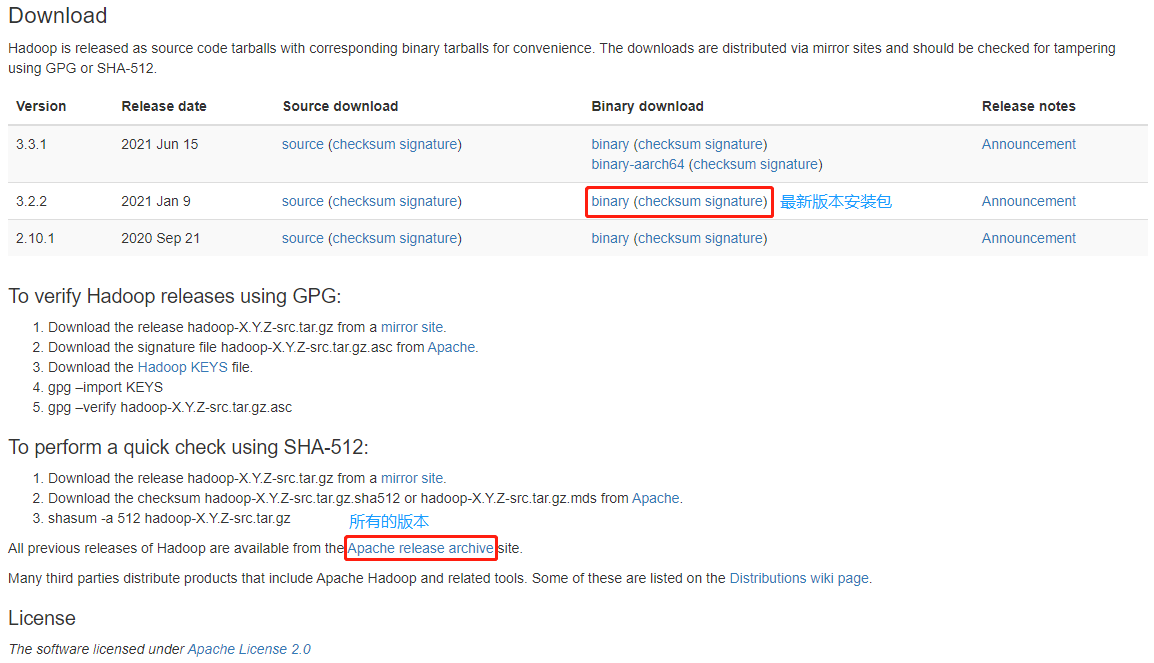

安装 Hadoop

下面步骤以 hadoop102 为例,进行说明。

下载地址:https://hadoop.apache.org/releases.html

公司生产环境使用的是 hadoop-3.2.1,此处保持一致。

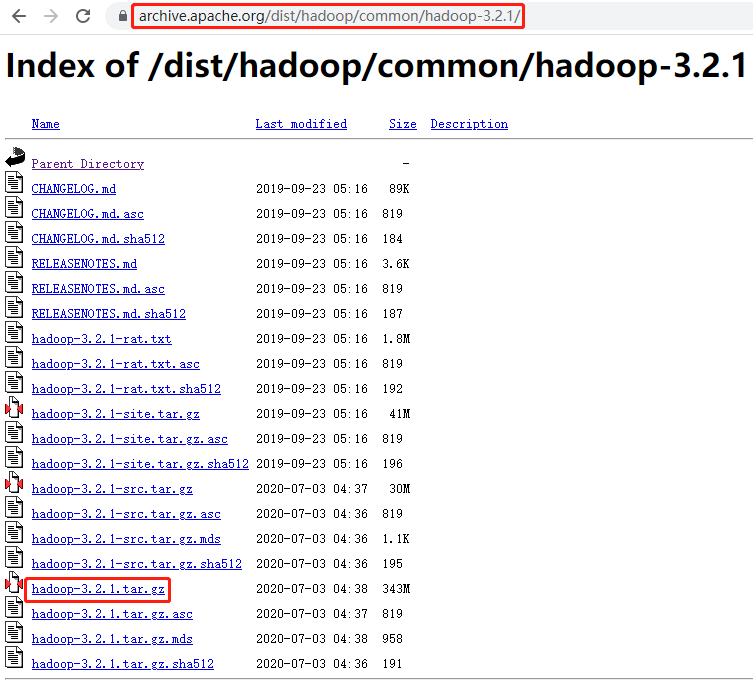

在

opt/software路径下,使用 wget 命令下载安装包:1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16[xisun@hadoop102 software]$ pwd

/opt/software

[xisun@hadoop102 software]$ wget https://archive.apache.org/dist/hadoop/common/hadoop-3.2.1/hadoop-3.2.1.tar.gz

--2021-08-31 11:44:19-- https://archive.apache.org/dist/hadoop/common/hadoop-3.2.1/hadoop-3.2.1.tar.gz

正在解析主机 archive.apache.org (archive.apache.org)... 138.201.131.134, 2a01:4f8:172:2ec5::2

正在连接 archive.apache.org (archive.apache.org)|138.201.131.134|:443... 已连接。

已发出 HTTP 请求,正在等待回应... 200 OK

长度:359196911 (343M) [application/x-gzip]

正在保存至: “hadoop-3.2.1.tar.gz”

100%[=========================================================================================================================================================================>] 359,196,911 57.8KB/s 用时 57m 32s

2021-08-31 12:41:54 (102 KB/s) - 已保存 “hadoop-3.2.1.tar.gz” [359196911/359196911])

[xisun@hadoop102 software]$ ll

总用量 350780

-rw-rw-r--. 1 xisun xisun 359196911 7月 3 2020 hadoop-3.2.1.tar.gz解压安装包到

/opt/module路径下面:1

[xisun@hadoop102 software]$ tar -zxvf hadoop-3.2.1.tar.gz -C /opt/module/

1

2

3[xisun@hadoop102 software]$ ll ../module/

总用量 0

drwxr-xr-x. 9 xisun xisun 149 9月 11 2019 hadoop-3.2.1将 Hadoop 添加到环境变量:

获取 Hadoop 安装路径:

1

2[xisun@hadoop102 hadoop-3.2.1]$ pwd

/opt/module/hadoop-3.2.1修改

etc/profile.d/my_env.sh文件,添加 Hadoop 环境变量:1

[xisun@hadoop102 hadoop-3.2.1]$ sudo vim /etc/profile.d/my_env.sh

1

2

3

4# HADOOP_HOME

export HADOOP_HOME=/opt/module/hadoop-3.2.1

export PATH=$PATH:$HADOOP_HOME/bin

export PATH=$PATH:$HADOOP_HOME/sbinsource 一下

/etc/profile文件,让新的环境变量 PATH 生效:1

[xisun@hadoop102 hadoop-3.2.1]$ source /etc/profile

查看配置是否生效:

1

2

3

4

5

6

7

8

9[xisun@hadoop102 hadoop-3.2.1]$ echo $HADOOP_HOME

/opt/module/hadoop-3.2.1

[xisun@hadoop102 hadoop-3.2.1]$ hadoop version

Hadoop 3.2.1

Source code repository https://gitbox.apache.org/repos/asf/hadoop.git -r b3cbbb467e22ea829b3808f4b7b01d07e0bf3842

Compiled by rohithsharmaks on 2019-09-10T15:56Z

Compiled with protoc 2.5.0

From source with checksum 776eaf9eee9c0ffc370bcbc1888737

This command was run using /opt/module/hadoop-3.2.1/share/hadoop/common/hadoop-common-3.2.1.jar

Hadoop 目录结构

查看 Hadoop 的目录结构:

1

2

3

4

5

6

7

8

9

10

11

12

13

14[xisun@hadoop102 hadoop-3.2.1]$ pwd

/opt/module/hadoop-3.2.1

[xisun@hadoop102 hadoop-3.2.1]$ ll

总用量 180

drwxr-xr-x. 2 xisun xisun 203 9月 11 2019 bin

drwxr-xr-x. 3 xisun xisun 20 9月 10 2019 etc

drwxr-xr-x. 2 xisun xisun 106 9月 11 2019 include

drwxr-xr-x. 3 xisun xisun 20 9月 11 2019 lib

drwxr-xr-x. 4 xisun xisun 288 9月 11 2019 libexec

-rw-rw-r--. 1 xisun xisun 150569 9月 10 2019 LICENSE.txt

-rw-rw-r--. 1 xisun xisun 22125 9月 10 2019 NOTICE.txt

-rw-rw-r--. 1 xisun xisun 1361 9月 10 2019 README.txt

drwxr-xr-x. 3 xisun xisun 4096 9月 10 2019 sbin

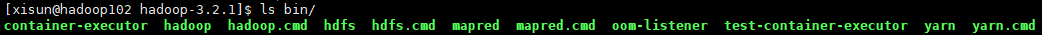

drwxr-xr-x. 4 xisun xisun 31 9月 11 2019 share重要目录

bin 目录:存放对 Hadoop 相关服务(hdfs,yarn,mapred)进行操作的脚本。

1

2[xisun@hadoop102 hadoop-3.2.1]$ ls bin/

container-executor hadoop hadoop.cmd hdfs hdfs.cmd mapred mapred.cmd oom-listener test-container-executor yarn yarn.cmd

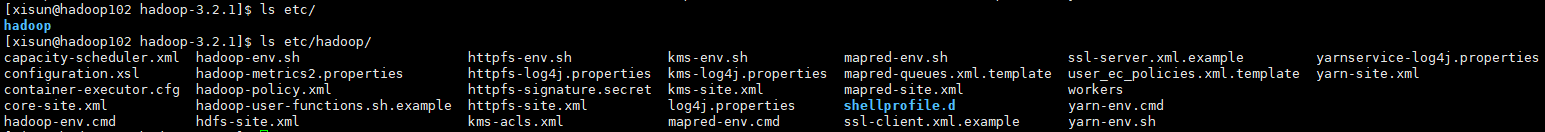

etc 目录:Hadoop 的配置文件目录,存放 Hadoop 的配置文件。

1

2

3

4

5

6

7

8[xisun@hadoop102 hadoop-3.2.1]$ ls etc/

hadoop

[xisun@hadoop102 hadoop-3.2.1]$ ls etc/hadoop/

capacity-scheduler.xml hadoop-env.sh httpfs-env.sh kms-env.sh mapred-env.sh ssl-server.xml.example yarnservice-log4j.properties

configuration.xsl hadoop-metrics2.properties httpfs-log4j.properties kms-log4j.properties mapred-queues.xml.template user_ec_policies.xml.template yarn-site.xml

container-executor.cfg hadoop-policy.xml httpfs-signature.secret kms-site.xml mapred-site.xml workers

core-site.xml hadoop-user-functions.sh.example httpfs-site.xml log4j.properties shellprofile.d yarn-env.cmd

hadoop-env.cmd hdfs-site.xml kms-acls.xml mapred-env.cmd ssl-client.xml.example yarn-env.sh

lib 目录:存放 Hadoop 的本地库(对数据进行压缩解压缩功能)。

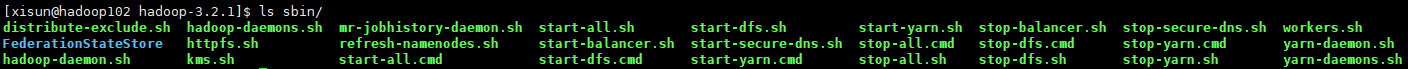

sbin 目录:存放启动或停止 Hadoop 相关服务的脚本。

1

2

3

4[xisun@hadoop102 hadoop-3.2.1]$ ls sbin/

distribute-exclude.sh hadoop-daemons.sh mr-jobhistory-daemon.sh start-all.sh start-dfs.sh start-yarn.sh stop-balancer.sh stop-secure-dns.sh workers.sh

FederationStateStore httpfs.sh refresh-namenodes.sh start-balancer.sh start-secure-dns.sh stop-all.cmd stop-dfs.cmd stop-yarn.cmd yarn-daemon.sh

hadoop-daemon.sh kms.sh start-all.cmd start-dfs.cmd start-yarn.cmd stop-all.sh stop-dfs.sh stop-yarn.sh yarn-daemons.sh

share 目录:存放 Hadoop 的依赖 JAR 包、文档、和官方案例。

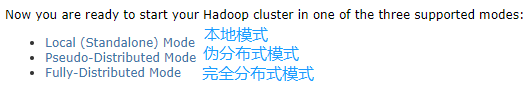

Hadoop 运行模式

Hadoop 官方网站:http://hadoop.apache.org/

Hadoop 运行模式包括:本地模式、伪分布式模式以及完全分布式模式。

- 本地模式:单机运行,只是用来演示一下官方案例。

- 数据存储在 Linux 本地,偶尔测试时使用。

- 伪分布式模式:也是单机运行,但是具备 Hadoop 集群的所有功能,一台服务器模拟一个分布式的环境。

- 数据存储在 HDFS 上,个别缺钱的公司用来测试,生产环境一般不用。

- 完全分布式模式:多台服务器组成分布式环境。

- 数据存储在 HDFS 上,企业生产环境大量使用。

- 本地模式:单机运行,只是用来演示一下官方案例。

本地模式

以官方 WordCount 进行说明。

第一步:在 hadoop-3.2.1 文件下面创建一个 wcinput 文件夹。

1

[xisun@hadoop102 hadoop-3.2.1]$ mkdir wcinput

第二步:在 wcinput 文件下创建一个 word.txt 文件,并输入一些单词做测试。

1

[xisun@hadoop102 wcinput]$ vim word.txt

1

2

3

4hadoop yarn

hadoop mapreduce

xisun

xisun第三步:回到 Hadoop 目录

/opt/module/hadoop-3.2.1。第四步:执行 wordcount 程序,统计 word.txt 文件中各单词的个数。

1

[xisun@hadoop102 hadoop-3.2.1]$ bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.2.1.jar wordcount wcinput/ ./wcoutput

本地模式下,输入路径

/wcinput和输出路径./wcoutput都是本地路径。注意:结果输出路径 wcoutput 不能已经存在,否则程序会报错

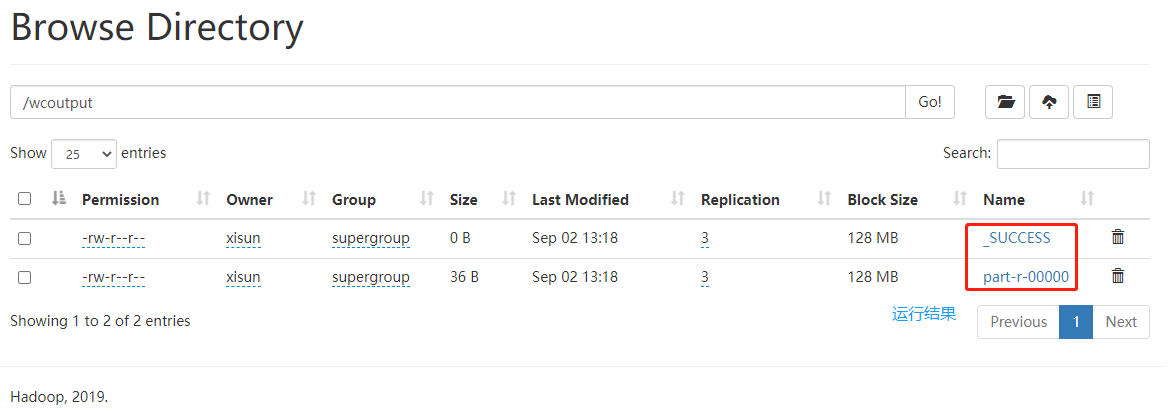

org.apache.hadoop.mapred.FileAlreadyExistsException: Output directory file:/opt/module/hadoop-3.2.1/wcoutput already exists。第五步:查看结果。

1

2

3

4

5

6

7

8

9

10[xisun@hadoop102 hadoop-3.2.1]$ cd wcoutput/

[xisun@hadoop102 wcoutput]$ ll

总用量 4

-rw-r--r--. 1 xisun xisun 36 8月 31 16:04 part-r-00000

-rw-r--r--. 1 xisun xisun 0 8月 31 16:04 _SUCCESS

[xisun@hadoop102 wcoutput]$ cat part-r-00000

hadoop 2

mapreduce 1

xisun 2

yarn 1

完全分布式模式

虚拟机准备

虚拟机 hadoop102 已准备好,参考前面章节。

在 hadoop103 和 hadoop104 安装 OpenJDK:

1

[xisun@hadoop103 ~]$ sudo yum install -y java-1.8.0-openjdk-devel

hadoop102,hadoop103 和 hadoop104 三台虚拟机,安装的 JDK 环境和 Hadoop 版本相同,因此,环境变量配置也相同。对于这种情况,不需要在每台虚拟机上再配置环境变量,可以使用 scp 或 rsync 命令等,直接拷贝模板虚拟机 hadoop102 上的配置文件到 hadoop103 和 hadoop104 上。在后面章节,也可以使用集群分发脚本 xsync 拷贝。

如果使用 scp 命令,拷贝 hadoop102 上环境变量配置的

etc/profile.d/my_env.sh文件到 hadoop103 和 hadoop104 的etc/profile.d路径下,方式如下。方式一,在 hadoop102 上使用 scp 命令,拷贝本地文件到 hadoop103 上:

1

2

3

4

5

6

7

8[xisun@hadoop102 profile.d]$ sudo scp /etc/profile.d/my_env.sh root@hadoop103:/etc/profile.d/

The authenticity of host 'hadoop103 (192.168.10.103)' can't be established.

ECDSA key fingerprint is SHA256:AOkUHU40E6uekNRiFpZkT4R2gfoE+s9ujdYTZ5e8kwM.

ECDSA key fingerprint is MD5:dd:80:45:3e:83:75:92:fe:57:d3:78:fa:af:5a:ca:1b.

Are you sure you want to continue connecting (yes/no)? yes

Warning: Permanently added 'hadoop103,192.168.10.103' (ECDSA) to the list of known hosts.

root@hadoop103's password:

my_env.sh方式二,在 hadoop104 上使用 scp 命令,拷贝 hadoop102 上的文件到本地:

1

2

3

4

5

6

7

8[xisun@hadoop104 profile.d]$ sudo scp root@hadoop102:/etc/profile.d/my_env.sh /etc/profile.d/

The authenticity of host 'hadoop102 (192.168.10.102)' can't be established.

ECDSA key fingerprint is SHA256:AOkUHU40E6uekNRiFpZkT4R2gfoE+s9ujdYTZ5e8kwM.

ECDSA key fingerprint is MD5:dd:80:45:3e:83:75:92:fe:57:d3:78:fa:af:5a:ca:1b.

Are you sure you want to continue connecting (yes/no)? yes

Warning: Permanently added 'hadoop102,192.168.10.102' (ECDSA) to the list of known hosts.

root@hadoop102's password:

my_env.sh方式三,在 hadoop103 上使用 scp 命令,拷贝 hadoop102 上的文件到 hadoop104 上:

1

[xisun@hadoop103 profile.d]$ sudo scp root@hadoop102:/etc/profile.d/my_env.sh root@hadoop104:/etc/profile.d/

如果使用集群分发脚本 xsync 拷贝,需要注意,my_env.sh 文件是 root 权限的,需要给脚本添加 sudo 命令,同时,xsync 脚本需要补全路径,否则 sudo 识别不出来:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29[xisun@hadoop102 ~]$ sudo /home/xisun/bin/xsync /etc/profile.d/my_env.sh

==================== hadoop102 ====================

root@hadoop102's password:

root@hadoop102's password:

sending incremental file list

sent 48 bytes received 12 bytes 24.00 bytes/sec

total size is 253 speedup is 4.22

==================== hadoop103 ====================

root@hadoop103's password:

root@hadoop103's password:

sending incremental file list

my_env.sh

sent 348 bytes received 35 bytes 153.20 bytes/sec

total size is 253 speedup is 0.66

==================== hadoop104 ====================

The authenticity of host 'hadoop104 (192.168.10.104)' can't be established.

ECDSA key fingerprint is SHA256:AOkUHU40E6uekNRiFpZkT4R2gfoE+s9ujdYTZ5e8kwM.

ECDSA key fingerprint is MD5:dd:80:45:3e:83:75:92:fe:57:d3:78:fa:af:5a:ca:1b.

Are you sure you want to continue connecting (yes/no)? yes

Warning: Permanently added 'hadoop104,192.168.10.104' (ECDSA) to the list of known hosts.

root@hadoop104's password:

root@hadoop104's password:

sending incremental file list

my_env.sh

sent 348 bytes received 35 bytes 153.20 bytes/sec

total size is 253 speedup is 0.66注意,需要输入的是各主机 root 用户的密码。

在 hadoop103 和 hadoop104 上 source 一下

/etc/profile文件,让新的环境变量 PATH 生效:1

2

3[xisun@hadoop103 ~]$ source /etc/profile

[xisun@hadoop103 ~]$ echo $JAVA_HOME

/usr/lib/jvm/java-1.8.0-openjdk-1.8.0.302.b08-0.el7_9.x86_641

2

3[xisun@hadoop104 ~]$ source /etc/profile

[xisun@hadoop104 ~]$ echo $JAVA_HOME

/usr/lib/jvm/java-1.8.0-openjdk-1.8.0.302.b08-0.el7_9.x86_64

编写集群分发脚本 xsync

scp(secure copy)安全拷贝

scp 可以实现服务器与服务器之间的数据拷贝。(from server1 to server2)

基本语法:

1

2scp -r $pdir/$fname $user@$host:$pdir/$fname

命令 递归 要拷贝的文件路径/名称 目的地用户@主机:目的地路径/名称实例:拷贝 hadoop102 上的 Hadoop 安装包到 hadoop103 和 hadoop104 上。

前提:在 hadoop102、hadoop103、hadoop104 三台虚拟机上,都已经创建好

/opt/module和/opt/software两个路径,并且已经把这两个路径的权限修改为 xisun:xisun。方式一,在 hadoop102 上使用 scp 命令,拷贝本地文件到 hadoop103 上:

1

2

3

4

5

6

7[xisun@hadoop102 opt]$ scp -r /opt/module/hadoop-3.2.1/ xisun@hadoop103:/opt/module/

The authenticity of host 'hadoop103 (192.168.10.103)' can't be established.

ECDSA key fingerprint is SHA256:AOkUHU40E6uekNRiFpZkT4R2gfoE+s9ujdYTZ5e8kwM.

ECDSA key fingerprint is MD5:dd:80:45:3e:83:75:92:fe:57:d3:78:fa:af:5a:ca:1b.

Are you sure you want to continue connecting (yes/no)? yes

Warning: Permanently added 'hadoop103,192.168.10.103' (ECDSA) to the list of known hosts.

xisun@hadoop103's password:

方式二,在 hadoop104 上使用 scp 命令,拷贝 hadoop102 上的文件到本地:

1

2

3

4

5

6

7[xisun@hadoop104 opt]$ scp -r xisun@hadoop102:/opt/module/hadoop-3.2.1/ /opt/module/

The authenticity of host 'hadoop102 (192.168.10.102)' can't be established.

ECDSA key fingerprint is SHA256:AOkUHU40E6uekNRiFpZkT4R2gfoE+s9ujdYTZ5e8kwM.

ECDSA key fingerprint is MD5:dd:80:45:3e:83:75:92:fe:57:d3:78:fa:af:5a:ca:1b.

Are you sure you want to continue connecting (yes/no)? yes

Warning: Permanently added 'hadoop104,192.168.10.102' (ECDSA) to the list of known hosts.

xisun@hadoop102's password:方式三,在 hadoop103 上使用 scp 命令,拷贝 hadoop102 上的文件到 hadoop104 上:

1

[xisun@hadoop103 opt]$ scp -r xisun@hadoop102:/opt/module/hadoop-3.2.1/ xisun@hadoop104:/opt/module/

rsync 远程同步工具

rsync 主要用于备份和镜像。具有速度快、避免复制相同内容和支持符号链接的优点。

rsync 和 scp 的区别:用 rsync 做文件的复制要比 scp 的速度快,rsync 只对差异文件做更新。scp 是把所有文件都复制过去。

rsync 第一次使用,等同于 scp。

基本语法:

1

2rsync -av $pdir/$fname $user@$host:$pdir/$fname

命令 选项参数 要拷贝的文件路径/名称 目的地用户@主机:目的地路径/名称参数说明:

选项 功能 -a 归档拷贝 -v 显示复制过程

实例:

删除 hadoop103 和 hadoop104 上

/opt/module/hadoop-3.2.1路径下的 wcinput 和 wcoutput 文件夹。1

[xisun@hadoop103 hadoop-3.2.1]$ rm -r wcinput/ wcoutput/

1

[xisun@hadoop104 hadoop-3.2.1]$ rm -r wcinput/ wcoutput/

同步 hadoop102 上的

/opt/module/hadoop-3.2.1到 hadoop103 和 hadoop104 上。方式一,在 hadoop102 上使用 rsync 命令,同步本地文件到 hadoop103 上:

1

2[xisun@hadoop102 ~]$ rsync -av /opt/module/hadoop-3.2.1/ xisun@hadoop103:/opt/module/hadoop-3.2.1/

xisun@hadoop103's password:方式二,在 hadoop104 上使用 rsync 命令,同步 hadoop102 上的文件到本地:

1

2

3

4

5

6

7[xisun@hadoop104 ~]$ rsync -av xisun@hadoop102:/opt/module/hadoop-3.2.1/ /opt/module/hadoop-3.2.1/

The authenticity of host 'hadoop102 (192.168.10.102)' can't be established.

ECDSA key fingerprint is SHA256:AOkUHU40E6uekNRiFpZkT4R2gfoE+s9ujdYTZ5e8kwM.

ECDSA key fingerprint is MD5:dd:80:45:3e:83:75:92:fe:57:d3:78:fa:af:5a:ca:1b.

Are you sure you want to continue connecting (yes/no)? yes

Warning: Permanently added 'hadoop102,192.168.10.102' (ECDSA) to the list of known hosts.

xisun@hadoop102's password:方式三,在 hadoop103 上使用 rsync 命令,同步 hadoop102 上的文件到 hadoop104 上:

1

[xisun@hadoop103 ~]$ rsync -av xisun@hadoop102:/opt/module/hadoop-3.2.1/ xisun@hadoop104:/opt/module/hadoop-3.2.1/

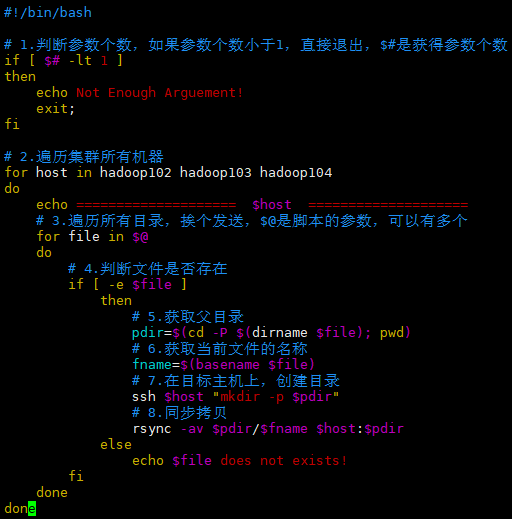

xsync 集群分发脚本

需求:编写脚本,指定需要同步的文件路径参数,能够循环复制该路径下的所有文件到所有节点的相同路径下。

需求分析:

使用 rsync 命令,实现同步拷贝。

期望脚本格式:

xsync 需要同步的文件名称期望脚本在任何路径都能使用:将脚本放在声明了全局环境变量的路径下。

查看全局变量的路径:

1

2[xisun@hadoop102 ~]$ echo $PATH

/usr/local/bin:/usr/bin:/usr/local/sbin:/usr/sbin:/home/xisun/.local/bin:/home/xisun/bin:/usr/lib/jvm/java-1.8.0-openjdk-1.8.0.302.b08-0.el7_9.x86_64/bin可以看出,在全局变量的路径中,有一个

/home/xisun/bin:,如果把编写的脚本 xsync 放在此路径下,即可在任何路径都能使用。或者,直接把脚本 xsync 所在的路径,配置到全局环境变量中也可以。

脚本实现:

在

/home/xisun路径下,创建 bin 目录:1

2

3

4

5

6

7

8

9

10

11

12

13

14[xisun@hadoop102 ~]$ pwd

/home/xisun

[xisun@hadoop102 ~]$ mkdir bin

[xisun@hadoop102 ~]$ ll

总用量 0

drwxrwxr-x. 2 xisun xisun 6 9月 1 11:43 bin

drwxr-xr-x. 2 xisun xisun 6 8月 28 23:56 公共

drwxr-xr-x. 2 xisun xisun 6 8月 28 23:56 模板

drwxr-xr-x. 2 xisun xisun 6 8月 28 23:56 视频

drwxr-xr-x. 2 xisun xisun 6 8月 28 23:56 图片

drwxr-xr-x. 2 xisun xisun 6 8月 28 23:56 文档

drwxr-xr-x. 2 xisun xisun 6 8月 28 23:56 下载

drwxr-xr-x. 2 xisun xisun 6 8月 28 23:56 音乐

drwxr-xr-x. 2 xisun xisun 6 8月 28 23:56 桌面在

/home/xisun/bin路径下,创建 xsync 文件,并添加脚本代码:1

2

3[xisun@hadoop102 bin]$ pwd

/home/xisun/bin

[xisun@hadoop102 bin]$ vim xsync1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32#!/bin/bash

# 1.判断参数个数,如果参数个数小于1,直接退出,$#是获得参数个数

if [ $# -lt 1 ]

then

echo Not Enough Arguement!

exit;

fi

# 2.遍历集群所有机器

for host in hadoop102 hadoop103 hadoop104

do

echo ==================== $host ====================

# 3.遍历所有目录,挨个发送,$@是脚本的参数,可以有多个

for file in $@

do

# 4.判断文件是否存在

if [ -e $file ]

then

# 5.获取父目录

pdir=$(cd -P $(dirname $file); pwd)

# 6.获取当前文件的名称

fname=$(basename $file)

# 7.在目标主机上,创建目录

ssh $host "mkdir -p $pdir"

# 8.同步拷贝

rsync -av $pdir/$fname $host:$pdir

else

echo $file does not exists!

fi

done

done

修改脚本 xsync,使其具有可执行权限:

1

2

3

4

5

6

7[xisun@hadoop102 bin]$ ll

总用量 4

-rw-rw-r--. 1 xisun xisun 908 9月 1 13:33 xsync

[xisun@hadoop102 bin]$ chmod 777 xsync

[xisun@hadoop102 bin]$ ll

总用量 4

-rwxrwxrwx. 1 xisun xisun 908 9月 1 13:33 xsync测试脚本,将 hadoop102 上的

/home/xisun/bin目录,同步到 hadoop103 和 hadoop104 上:1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33[xisun@hadoop102 ~]$ pwd

/home/xisun

[xisun@hadoop102 ~]$ xsync /home/xisun/bin/

==================== hadoop102 ====================

The authenticity of host 'hadoop102 (192.168.10.102)' can't be established.

ECDSA key fingerprint is SHA256:AOkUHU40E6uekNRiFpZkT4R2gfoE+s9ujdYTZ5e8kwM.

ECDSA key fingerprint is MD5:dd:80:45:3e:83:75:92:fe:57:d3:78:fa:af:5a:ca:1b.

Are you sure you want to continue connecting (yes/no)? yes

Warning: Permanently added 'hadoop102,192.168.10.102' (ECDSA) to the list of known hosts.

xisun@hadoop102's password:

xisun@hadoop102's password:

sending incremental file list

sent 90 bytes received 17 bytes 16.46 bytes/sec

total size is 908 speedup is 8.49

==================== hadoop103 ====================

xisun@hadoop103's password:

xisun@hadoop103's password:

sending incremental file list

bin/

bin/xsync

sent 1,044 bytes received 39 bytes 196.91 bytes/sec

total size is 908 speedup is 0.84

==================== hadoop104 ====================

xisun@hadoop104's password:

xisun@hadoop104's password:

sending incremental file list

bin/

bin/xsync

sent 1,044 bytes received 39 bytes 240.67 bytes/sec

total size is 908 speedup is 0.84

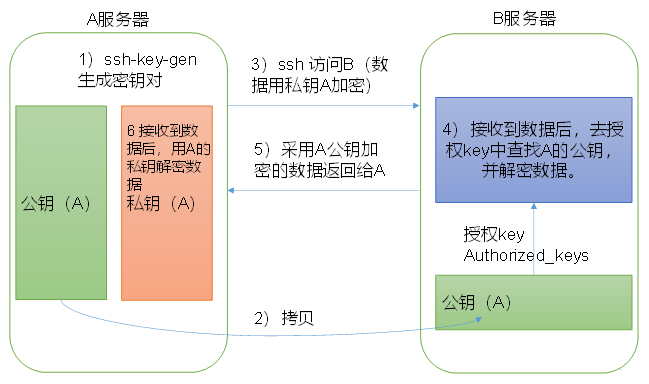

ssh 免密登录配置

ssh 命令可以在当前主机上,连接另一台主机,在连接过程中,需要另一台主机的通行密码。

基本语法:

ssh 另一台主机的IP地址ssh 连接时出现 Host key verification failed 的解决方法:输入 yes 并回车。

1

Are you sure you want to continue connecting (yes/no)?

ssh 连接到另一台主机后,使用 exit 命令可以回到原来的主机:

1

2

3

4

5

6

7[xisun@hadoop102 ~]$ ssh hadoop103

xisun@hadoop103's password:

Last login: Tue Aug 31 16:47:43 2021 from 192.168.10.1

[xisun@hadoop103 ~]$ exit

登出

Connection to hadoop103 closed.

[xisun@hadoop102 ~]$

免密钥配置

免密登录原理:

在 hadoop102 生成公钥和私钥:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28[xisun@hadoop102 .ssh]$ pwd

/home/xisun/.ssh

[xisun@hadoop102 .ssh]$ ssh-keygen -t rsa

Generating public/private rsa key pair.

Enter file in which to save the key (/home/xisun/.ssh/id_rsa):

Enter passphrase (empty for no passphrase):

Enter same passphrase again:

Your identification has been saved in /home/xisun/.ssh/id_rsa.

Your public key has been saved in /home/xisun/.ssh/id_rsa.pub.

The key fingerprint is:

SHA256:j9G3rd2/lBjPliez4vXcinw0R5CJy8mja0u7wBWgPDU xisun@hadoop102

The key's randomart image is:

+---[RSA 2048]----+

| E . o |

| . o o . + |

| + .o o . |

| . . .* .|

| S o..o . |

| . =.. oB +|

| + o..o=X.|

| ooo.=+Bo|

| .++=o+oO|

+----[SHA256]-----+

[xisun@hadoop102 .ssh]$ ll

总用量 12

-rw-------. 1 xisun xisun 1675 9月 1 15:59 id_rsa

-rw-r--r--. 1 xisun xisun 397 9月 1 15:59 id_rsa.pub

-rw-r--r--. 1 xisun xisun 558 9月 1 14:29 known_hosts- 在

/home/xisun/.ssh路径下,执行ssh-keygen -t rsa命令,敲三次回车,即可生成两个文件,私钥和公钥。 - id_rsa 为 hadoop102 的私钥,id_rsa.pub 为 hadoop102 的公钥。

- 在

将 hadoop102 的公钥,拷贝到要免密登录的目标机器上,即 hadoop102,hadoop103 和 hadoop104:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17[xisun@hadoop102 ~]$ ssh-copy-id hadoop102

/usr/bin/ssh-copy-id: INFO: Source of key(s) to be installed: "/home/xisun/.ssh/id_rsa.pub"

/usr/bin/ssh-copy-id: INFO: attempting to log in with the new key(s), to filter out any that are already installed

/usr/bin/ssh-copy-id: INFO: 1 key(s) remain to be installed -- if you are prompted now it is to install the new keys

xisun@hadoop102's password:

Number of key(s) added: 1

Now try logging into the machine, with: "ssh 'hadoop102'"

and check to make sure that only the key(s) you wanted were added.

[xisun@hadoop102 ~]$ ssh hadoop102

Last login: Wed Sep 1 16:11:59 2021 from hadoop102

[xisun@hadoop102 ~]$ exit

登出

Connection to hadoop102 closed.

[xisun@hadoop102 ~]$1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17[xisun@hadoop102 .ssh]$ ssh-copy-id hadoop103

/usr/bin/ssh-copy-id: INFO: Source of key(s) to be installed: "/home/xisun/.ssh/id_rsa.pub"

/usr/bin/ssh-copy-id: INFO: attempting to log in with the new key(s), to filter out any that are already installed

/usr/bin/ssh-copy-id: INFO: 1 key(s) remain to be installed -- if you are prompted now it is to install the new keys

xisun@hadoop103's password:

Number of key(s) added: 1

Now try logging into the machine, with: "ssh 'hadoop103'"

and check to make sure that only the key(s) you wanted were added.

[xisun@hadoop102 .ssh]$ ssh hadoop103

Last login: Wed Sep 1 15:02:49 2021 from hadoop102

[xisun@hadoop103 ~]$ exit

登出

Connection to hadoop103 closed.

[xisun@hadoop102 .ssh]$1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19[xisun@hadoop102 .ssh]$ ssh-copy-id hadoop104

/usr/bin/ssh-copy-id: INFO: Source of key(s) to be installed: "/home/xisun/.ssh/id_rsa.pub"

/usr/bin/ssh-copy-id: INFO: attempting to log in with the new key(s), to filter out any that are already installed

/usr/bin/ssh-copy-id: INFO: 1 key(s) remain to be installed -- if you are prompted now it is to install the new keys

xisun@hadoop104's password:

Number of key(s) added: 1

Now try logging into the machine, with: "ssh 'hadoop104'"

and check to make sure that only the key(s) you wanted were added.

[xisun@hadoop102 .ssh]$ ssh hadoop104

Last failed login: Wed Sep 1 14:43:15 CST 2021 from hadoop102 on ssh:notty

There was 1 failed login attempt since the last successful login.

Last login: Tue Aug 31 16:48:06 2021 from 192.168.10.1

[xisun@hadoop104 ~]$ exit

登出

Connection to hadoop104 closed.

[xisun@hadoop102 .ssh]$按上面同样的步骤,对 hadoop103 和 hadoop104 进行 ssh 免密登录配置。

注意:上面的配置只对 xisun 用户有效,如果希望 root 用户也能免密 ssh 登录,需要切换到 root 账号,做同样的配置:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83[xisun@hadoop102 ~]$ su root

密码:

[root@hadoop102 xisun]# cd .ssh/

[root@hadoop102 .ssh]# pwd

/home/xisun/.ssh

[root@hadoop102 .ssh]# ll

总用量 16

-rw-------. 1 xisun xisun 1191 9月 1 16:32 authorized_keys

-rw-------. 1 xisun xisun 1675 9月 1 15:59 id_rsa

-rw-r--r--. 1 xisun xisun 397 9月 1 15:59 id_rsa.pub

-rw-r--r--. 1 xisun xisun 558 9月 1 14:29 known_hosts

[root@hadoop102 .ssh]# ssh-keygen -t rsa

Generating public/private rsa key pair.

Enter file in which to save the key (/root/.ssh/id_rsa):

Enter passphrase (empty for no passphrase):

Enter same passphrase again:

Your identification has been saved in /root/.ssh/id_rsa.

Your public key has been saved in /root/.ssh/id_rsa.pub.

The key fingerprint is:

SHA256:AQtFVBbgnBrY8u/vIGgxFUxqHtKOYzKFIVRbHNJoMEw root@hadoop102

The key's randomart image is:

+---[RSA 2048]----+

|*Eo=B*Bo+. |

|.=.*=B = |

|o X.+ = . |

| B = o . |

|=.= o S |

|oo + . |

| o . o |

| . o . |

| .oo |

+----[SHA256]-----+

[root@hadoop102 .ssh]# ssh-copy-id hadoop102

/usr/bin/ssh-copy-id: INFO: Source of key(s) to be installed: "/root/.ssh/id_rsa.pub"

/usr/bin/ssh-copy-id: INFO: attempting to log in with the new key(s), to filter out any that are already installed

/usr/bin/ssh-copy-id: INFO: 1 key(s) remain to be installed -- if you are prompted now it is to install the new keys

root@hadoop102's password:

Number of key(s) added: 1

Now try logging into the machine, with: "ssh 'hadoop102'"

and check to make sure that only the key(s) you wanted were added.

[root@hadoop102 .ssh]# ssh hadoop102

Last login: Wed Sep 1 16:41:01 2021

[root@hadoop102 ~]# exit

登出

Connection to hadoop102 closed.

[root@hadoop102 .ssh]# ssh-copy-id hadoop103

/usr/bin/ssh-copy-id: INFO: Source of key(s) to be installed: "/root/.ssh/id_rsa.pub"

/usr/bin/ssh-copy-id: INFO: attempting to log in with the new key(s), to filter out any that are already installed

/usr/bin/ssh-copy-id: INFO: 1 key(s) remain to be installed -- if you are prompted now it is to install the new keys

root@hadoop103's password:

Number of key(s) added: 1

Now try logging into the machine, with: "ssh 'hadoop103'"

and check to make sure that only the key(s) you wanted were added.

[root@hadoop102 .ssh]# ssh hadoop103

Last failed login: Wed Sep 1 14:48:11 CST 2021 from hadoop102 on ssh:notty

There was 1 failed login attempt since the last successful login.

Last login: Tue Aug 31 10:02:38 2021

exi[root@hadoop103 ~]# exit

登出

Connection to hadoop103 closed.

[root@hadoop102 .ssh]# ssh-copy-id hadoop104

/usr/bin/ssh-copy-id: INFO: Source of key(s) to be installed: "/root/.ssh/id_rsa.pub"

/usr/bin/ssh-copy-id: INFO: attempting to log in with the new key(s), to filter out any that are already installed

/usr/bin/ssh-copy-id: INFO: 1 key(s) remain to be installed -- if you are prompted now it is to install the new keys

root@hadoop104's password:

Number of key(s) added: 1

Now try logging into the machine, with: "ssh 'hadoop104'"

and check to make sure that only the key(s) you wanted were added.

[root@hadoop102 .ssh]# ssh hadoop104

Last login: Wed Sep 1 16:39:50 2021

[root@hadoop104 ~]# exit

登出

Connection to hadoop104 closed.

[root@hadoop102 .ssh]#配置完免密登录后,测试可以看出,使用 xsync 脚本分发文件时,不需要输入密码:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18[xisun@hadoop102 ~]$ xsync a.txt

==================== hadoop102 ====================

sending incremental file list

sent 58 bytes received 12 bytes 46.67 bytes/sec

total size is 0 speedup is 0.00

==================== hadoop103 ====================

sending incremental file list

a.txt

sent 101 bytes received 35 bytes 272.00 bytes/sec

total size is 0 speedup is 0.00

==================== hadoop104 ====================

sending incremental file list

a.txt

sent 101 bytes received 35 bytes 272.00 bytes/sec

total size is 0 speedup is 0.00/home/xisun/.ssh路径下的文件功能解释:1

2

3

4

5

6[xisun@hadoop102 .ssh]$ ll

总用量 16

-rw-------. 1 xisun xisun 397 9月 1 16:12 authorized_keys

-rw-------. 1 xisun xisun 1675 9月 1 15:59 id_rsa

-rw-r--r--. 1 xisun xisun 397 9月 1 15:59 id_rsa.pub

-rw-r--r--. 1 xisun xisun 558 9月 1 14:29 known_hosts文件名 功能 known_hosts 记录当前主机ssh访问过的计算机的公钥(public key) id_rsa 当前主机生成的私钥 id_rsa.pub 当前主机生成的公钥 authorized_keys 存放授权过的无密登录服务器公钥

集群配置

集群部署规划

| hadoop102 | hadoop103 | hadoop104 | |

|---|---|---|---|

| HDFS | NameNode DataNode |

DataNode |

SecondaryNameNode DataNode |

| YARN | NodeManager |

ResourceManager NodeManager |

NodeManager |

- NameNode 和 SecondaryNameNode 都比较消耗内存,不要安装在同一台服务器上。

- ResourceManager 也很消耗内存,不要和 NameNode、SecondaryNameNode 配置在同一台服务器上。

配置文件说明

Hadoop 配置文件分两类:默认配置文件和自定义配置文件。只有用户想修改某一默认配置值时,才需要修改自定义配置文件,更改相应属性值。

默认配置文件

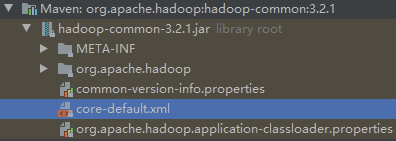

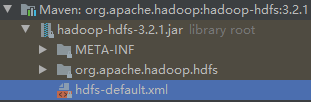

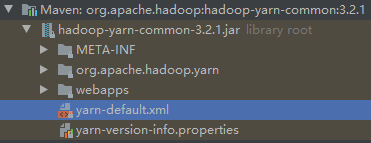

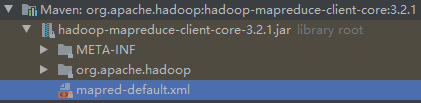

要获取的默认文件 文件存放在Hadoop的JAR包中的位置 [core-default.xml] hadoop-common-3.2.1.jar/core-default.xml [hdfs-default.xml] hadoop-hdfs-3.2.1.jar/hdfs-default.xml [yarn-default.xml] hadoop-yarn-common-3.2.1.jar/yarn-default.xml [mapred-default.xml] hadoop-mapreduce-client-core-3.2.1.jar/mapred-default.xml core-default.xml:

hdfs-default.xml:

需要添加依赖才能看到:

1

2

3

4

5<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-hdfs</artifactId>

<version>${hadoop.version}</version>

</dependency>

yarn-default.xml:

mapred-default.xml:

自定义配置文件

Hadoop 的四个默认配置文件,分别对应以下四个自定义配置文件:core-site.xml、hdfs-site.xml、yarn-site.xml、mapred-site.xml。这四个自定义配置文件,存放在

$HADOOP_HOME/etc/hadoop这个路径上,用户可以根据项目需求重新进行修改配置。1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36[xisun@hadoop102 hadoop]$ pwd

/opt/module/hadoop-3.2.1/etc/hadoop

[xisun@hadoop102 hadoop]$ ll

总用量 172

-rw-r--r--. 1 xisun xisun 8260 9月 11 2019 capacity-scheduler.xml

-rw-r--r--. 1 xisun xisun 1335 9月 11 2019 configuration.xsl

-rw-r--r--. 1 xisun xisun 1940 9月 11 2019 container-executor.cfg

-rw-r--r--. 1 xisun xisun 774 9月 10 2019 core-site.xml

-rw-r--r--. 1 xisun xisun 3999 9月 10 2019 hadoop-env.cmd

-rw-r--r--. 1 xisun xisun 16235 9月 11 2019 hadoop-env.sh

-rw-r--r--. 1 xisun xisun 3321 9月 10 2019 hadoop-metrics2.properties

-rw-r--r--. 1 xisun xisun 11392 9月 10 2019 hadoop-policy.xml

-rw-r--r--. 1 xisun xisun 3414 9月 10 2019 hadoop-user-functions.sh.example

-rw-r--r--. 1 xisun xisun 775 9月 11 2019 hdfs-site.xml

-rw-r--r--. 1 xisun xisun 1484 9月 11 2019 httpfs-env.sh

-rw-r--r--. 1 xisun xisun 1657 9月 11 2019 httpfs-log4j.properties

-rw-r--r--. 1 xisun xisun 21 9月 11 2019 httpfs-signature.secret

-rw-r--r--. 1 xisun xisun 620 9月 11 2019 httpfs-site.xml

-rw-r--r--. 1 xisun xisun 3518 9月 10 2019 kms-acls.xml

-rw-r--r--. 1 xisun xisun 1351 9月 10 2019 kms-env.sh

-rw-r--r--. 1 xisun xisun 1860 9月 10 2019 kms-log4j.properties

-rw-r--r--. 1 xisun xisun 682 9月 10 2019 kms-site.xml

-rw-r--r--. 1 xisun xisun 13326 9月 10 2019 log4j.properties

-rw-r--r--. 1 xisun xisun 951 9月 11 2019 mapred-env.cmd

-rw-r--r--. 1 xisun xisun 1764 9月 11 2019 mapred-env.sh

-rw-r--r--. 1 xisun xisun 4113 9月 11 2019 mapred-queues.xml.template

-rw-r--r--. 1 xisun xisun 758 9月 11 2019 mapred-site.xml

drwxr-xr-x. 2 xisun xisun 24 9月 10 2019 shellprofile.d

-rw-r--r--. 1 xisun xisun 2316 9月 10 2019 ssl-client.xml.example

-rw-r--r--. 1 xisun xisun 2697 9月 10 2019 ssl-server.xml.example

-rw-r--r--. 1 xisun xisun 2642 9月 11 2019 user_ec_policies.xml.template

-rw-r--r--. 1 xisun xisun 10 9月 10 2019 workers

-rw-r--r--. 1 xisun xisun 2250 9月 11 2019 yarn-env.cmd

-rw-r--r--. 1 xisun xisun 6056 9月 11 2019 yarn-env.sh

-rw-r--r--. 1 xisun xisun 2591 9月 11 2019 yarnservice-log4j.properties

-rw-r--r--. 1 xisun xisun 690 9月 11 2019 yarn-site.xml

配置集群

第一步:核心配置文件 — 配置 core-site.xml。

1

2

3[xisun@hadoop102 hadoop]$ pwd

/opt/module/hadoop-3.2.1/etc/hadoop

[xisun@hadoop102 hadoop]$ vim core-site.xml1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

<!--

Licensed under the Apache License, Version 2.0 (the "License");

you may not use this file except in compliance with the License.

You may obtain a copy of the License at

http://www.apache.org/licenses/LICENSE-2.0

Unless required by applicable law or agreed to in writing, software

distributed under the License is distributed on an "AS IS" BASIS,

WITHOUT WARRANTIES OR CONDITIONS OF ANY KIND, either express or implied.

See the License for the specific language governing permissions and

limitations under the License. See accompanying LICENSE file.

-->

<!-- Put site-specific property overrides in this file. -->

<configuration>

<!-- 指定NameNode的地址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop102:8020</value>

</property>

<!-- 指定Hadoop数据的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/module/hadoop-3.2.1/data</value>

</property>

</configuration>第二步:HDFS 配置文件 — 配置 hdfs-site.xml。

1

2

3[xisun@hadoop102 hadoop]$ pwd

/opt/module/hadoop-3.2.1/etc/hadoop

[xisun@hadoop102 hadoop]$ vim hdfs-site.xml1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

<!--

Licensed under the Apache License, Version 2.0 (the "License");

you may not use this file except in compliance with the License.

You may obtain a copy of the License at

http://www.apache.org/licenses/LICENSE-2.0

Unless required by applicable law or agreed to in writing, software

distributed under the License is distributed on an "AS IS" BASIS,

WITHOUT WARRANTIES OR CONDITIONS OF ANY KIND, either express or implied.

See the License for the specific language governing permissions and

limitations under the License. See accompanying LICENSE file.

-->

<!-- Put site-specific property overrides in this file. -->

<configuration>

<!-- nn web端访问地址 -->

<property>

<name>dfs.namenode.http-address</name>

<value>hadoop102:9870</value>

</property>

<!-- 2nn web端访问地址 -->

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hadoop104:9868</value>

</property>

</configuration>第三步:YARN 配置文件 — 配置 yarn-site.xml。

1

2

3[xisun@hadoop102 hadoop]$ pwd

/opt/module/hadoop-3.2.1/etc/hadoop

[xisun@hadoop102 hadoop]$ vim yarn-site.xml1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

<!--

Licensed under the Apache License, Version 2.0 (the "License");

you may not use this file except in compliance with the License.

You may obtain a copy of the License at

http://www.apache.org/licenses/LICENSE-2.0

Unless required by applicable law or agreed to in writing, software

distributed under the License is distributed on an "AS IS" BASIS,

WITHOUT WARRANTIES OR CONDITIONS OF ANY KIND, either express or implied.

See the License for the specific language governing permissions and

limitations under the License. See accompanying LICENSE file.

-->

<configuration>

<!-- Site specific YARN configuration properties -->

<!-- 指定MapReduce走shuffle -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!-- 指定ResourceManager的地址 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop103</value>

</property>

</configuration>第四步:MapReduce 配置文件 — 配置 mapred-site.xml。

1

2

3[xisun@hadoop102 hadoop]$ pwd

/opt/module/hadoop-3.2.1/etc/hadoop

[xisun@hadoop102 hadoop]$ vim mapred-site.xml1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

<!--

Licensed under the Apache License, Version 2.0 (the "License");

you may not use this file except in compliance with the License.

You may obtain a copy of the License at

http://www.apache.org/licenses/LICENSE-2.0

Unless required by applicable law or agreed to in writing, software

distributed under the License is distributed on an "AS IS" BASIS,

WITHOUT WARRANTIES OR CONDITIONS OF ANY KIND, either express or implied.

See the License for the specific language governing permissions and

limitations under the License. See accompanying LICENSE file.

-->

<!-- Put site-specific property overrides in this file. -->

<configuration>

<!-- 指定MapReduce程序运行在Yarn上 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>第五步:在集群上分发在 hadoop102 上配置好的 Hadoop 配置文件。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26[xisun@hadoop102 hadoop]$ xsync /opt/module/hadoop-3.2.1/etc/hadoop/

==================== hadoop102 ====================

sending incremental file list

sent 972 bytes received 18 bytes 1,980.00 bytes/sec

total size is 107,791 speedup is 108.88

==================== hadoop103 ====================

sending incremental file list

hadoop/

hadoop/core-site.xml

hadoop/hdfs-site.xml

hadoop/mapred-site.xml

hadoop/yarn-site.xml

sent 3,165 bytes received 139 bytes 2,202.67 bytes/sec

total size is 107,791 speedup is 32.62

==================== hadoop104 ====================

sending incremental file list

hadoop/

hadoop/core-site.xml

hadoop/hdfs-site.xml

hadoop/mapred-site.xml

hadoop/yarn-site.xml

sent 3,165 bytes received 139 bytes 6,608.00 bytes/sec

total size is 107,791 speedup is 32.62第六步:到 hadoop103 和 hadoop104 上查看文件分发情况。

1

[xisun@hadoop103 ~]$ cat /opt/module/hadoop-3.2.1/etc/hadoop/core-site.xml

1

[xisun@hadoop104 ~]$ cat /opt/module/hadoop-3.2.1/etc/hadoop/core-site.xml

群起集群

配置 workers

打开 workers 文件,删除默认值 localhost,然后向 workers 文件中添加如下内容:

1

2

3[xisun@hadoop102 hadoop]$ pwd

/opt/module/hadoop-3.2.1/etc/hadoop

[xisun@hadoop102 hadoop]$ vim workers1

2

3hadoop102

hadoop103

hadoop104workers 文件中添加的主机名,即是 Hadoop 集群中的各个节点。

注意:workers 文件中添加的内容结尾不允许有空格,文件中不允许有空行。

同步所有节点配置文件:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18[xisun@hadoop102 hadoop]$ xsync /opt/module/hadoop-3.2.1/etc/hadoop/workers

==================== hadoop102 ====================

sending incremental file list

sent 59 bytes received 12 bytes 142.00 bytes/sec

total size is 30 speedup is 0.42

==================== hadoop103 ====================

sending incremental file list

workers

sent 136 bytes received 41 bytes 354.00 bytes/sec

total size is 30 speedup is 0.17

==================== hadoop104 ====================

sending incremental file list

workers

sent 136 bytes received 41 bytes 354.00 bytes/sec

total size is 30 speedup is 0.17

启动集群

第一步:如果集群是第一次启动,需要在配置了 NameNode 的节点(hadoop102)上格式化 NameNode。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98[xisun@hadoop102 ~]$ hdfs namenode -format

WARNING: /opt/module/hadoop-3.2.1/logs does not exist. Creating.

2021-09-01 22:39:39,794 INFO namenode.NameNode: STARTUP_MSG:

/************************************************************

STARTUP_MSG: Starting NameNode

STARTUP_MSG: host = hadoop102/192.168.10.102

STARTUP_MSG: args = [-format]

STARTUP_MSG: version = 3.2.1

STARTUP_MSG: classpath = /opt/module/hadoop-3.2.1/etc/hadoop:…… ……

STARTUP_MSG: build = https://gitbox.apache.org/repos/asf/hadoop.git -r b3cbbb467e22ea829b3808f4b7b01d07e0bf3842; compiled by 'rohithsharmaks' on 2019-09-10T15:56Z

STARTUP_MSG: java = 1.8.0_302

************************************************************/

2021-09-01 22:39:40,092 INFO namenode.NameNode: registered UNIX signal handlers for [TERM, HUP, INT]

2021-09-01 22:39:42,475 INFO namenode.NameNode: createNameNode [-format]

Formatting using clusterid: CID-ffd49d0a-1e29-4912-91a7-0d6ce7121fda

2021-09-01 22:39:49,477 INFO namenode.FSEditLog: Edit logging is async:true

2021-09-01 22:39:52,982 INFO namenode.FSNamesystem: KeyProvider: null

2021-09-01 22:39:53,002 INFO namenode.FSNamesystem: fsLock is fair: true

2021-09-01 22:39:53,037 INFO namenode.FSNamesystem: Detailed lock hold time metrics enabled: false

2021-09-01 22:39:53,112 INFO namenode.FSNamesystem: fsOwner = xisun (auth:SIMPLE)

2021-09-01 22:39:53,112 INFO namenode.FSNamesystem: supergroup = supergroup

2021-09-01 22:39:53,113 INFO namenode.FSNamesystem: isPermissionEnabled = true

2021-09-01 22:39:53,113 INFO namenode.FSNamesystem: HA Enabled: false

2021-09-01 22:39:54,396 INFO common.Util: dfs.datanode.fileio.profiling.sampling.percentage set to 0. Disabling file IO profiling

2021-09-01 22:39:54,448 INFO blockmanagement.DatanodeManager: dfs.block.invalidate.limit: configured=1000, counted=60, effected=1000

2021-09-01 22:39:54,448 INFO blockmanagement.DatanodeManager: dfs.namenode.datanode.registration.ip-hostname-check=true

2021-09-01 22:39:54,617 INFO blockmanagement.BlockManager: dfs.namenode.startup.delay.block.deletion.sec is set to 000:00:00:00.000

2021-09-01 22:39:54,618 INFO blockmanagement.BlockManager: The block deletion will start around 2021 九月 01 22:39:54

2021-09-01 22:39:54,621 INFO util.GSet: Computing capacity for map BlocksMap

2021-09-01 22:39:54,621 INFO util.GSet: VM type = 64-bit

2021-09-01 22:39:54,654 INFO util.GSet: 2.0% max memory 441 MB = 8.8 MB

2021-09-01 22:39:54,654 INFO util.GSet: capacity = 2^20 = 1048576 entries

2021-09-01 22:39:54,679 INFO blockmanagement.BlockManager: Storage policy satisfier is disabled

2021-09-01 22:39:54,679 INFO blockmanagement.BlockManager: dfs.block.access.token.enable = false

2021-09-01 22:39:54,707 INFO Configuration.deprecation: No unit for dfs.namenode.safemode.extension(30000) assuming MILLISECONDS

2021-09-01 22:39:54,707 INFO blockmanagement.BlockManagerSafeMode: dfs.namenode.safemode.threshold-pct = 0.9990000128746033

2021-09-01 22:39:54,708 INFO blockmanagement.BlockManagerSafeMode: dfs.namenode.safemode.min.datanodes = 0

2021-09-01 22:39:54,708 INFO blockmanagement.BlockManagerSafeMode: dfs.namenode.safemode.extension = 30000

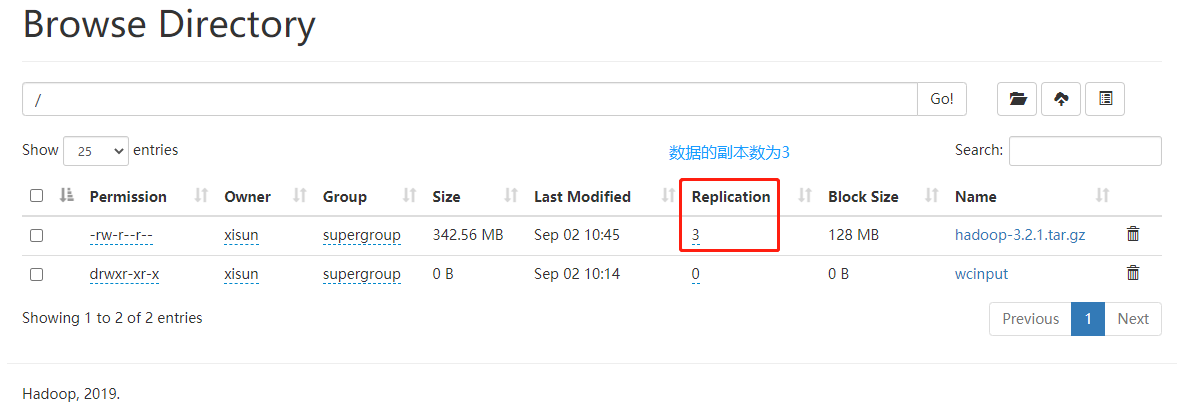

2021-09-01 22:39:54,708 INFO blockmanagement.BlockManager: defaultReplication = 3

2021-09-01 22:39:54,709 INFO blockmanagement.BlockManager: maxReplication = 512

2021-09-01 22:39:54,709 INFO blockmanagement.BlockManager: minReplication = 1

2021-09-01 22:39:54,709 INFO blockmanagement.BlockManager: maxReplicationStreams = 2

2021-09-01 22:39:54,709 INFO blockmanagement.BlockManager: redundancyRecheckInterval = 3000ms

2021-09-01 22:39:54,709 INFO blockmanagement.BlockManager: encryptDataTransfer = false

2021-09-01 22:39:54,709 INFO blockmanagement.BlockManager: maxNumBlocksToLog = 1000

2021-09-01 22:39:54,794 INFO namenode.FSDirectory: GLOBAL serial map: bits=29 maxEntries=536870911

2021-09-01 22:39:54,794 INFO namenode.FSDirectory: USER serial map: bits=24 maxEntries=16777215

2021-09-01 22:39:54,794 INFO namenode.FSDirectory: GROUP serial map: bits=24 maxEntries=16777215

2021-09-01 22:39:54,794 INFO namenode.FSDirectory: XATTR serial map: bits=24 maxEntries=16777215

2021-09-01 22:39:54,831 INFO util.GSet: Computing capacity for map INodeMap

2021-09-01 22:39:54,832 INFO util.GSet: VM type = 64-bit

2021-09-01 22:39:54,832 INFO util.GSet: 1.0% max memory 441 MB = 4.4 MB

2021-09-01 22:39:54,832 INFO util.GSet: capacity = 2^19 = 524288 entries

2021-09-01 22:39:54,833 INFO namenode.FSDirectory: ACLs enabled? false

2021-09-01 22:39:54,834 INFO namenode.FSDirectory: POSIX ACL inheritance enabled? true

2021-09-01 22:39:54,834 INFO namenode.FSDirectory: XAttrs enabled? true

2021-09-01 22:39:54,834 INFO namenode.NameNode: Caching file names occurring more than 10 times

2021-09-01 22:39:54,847 INFO snapshot.SnapshotManager: Loaded config captureOpenFiles: false, skipCaptureAccessTimeOnlyChange: false, snapshotDiffAllowSnapRootDescendant: true, maxSnapshotLimit: 65536

2021-09-01 22:39:54,859 INFO snapshot.SnapshotManager: SkipList is disabled

2021-09-01 22:39:54,868 INFO util.GSet: Computing capacity for map cachedBlocks

2021-09-01 22:39:54,868 INFO util.GSet: VM type = 64-bit

2021-09-01 22:39:54,868 INFO util.GSet: 0.25% max memory 441 MB = 1.1 MB

2021-09-01 22:39:54,868 INFO util.GSet: capacity = 2^17 = 131072 entries

2021-09-01 22:39:54,899 INFO metrics.TopMetrics: NNTop conf: dfs.namenode.top.window.num.buckets = 10

2021-09-01 22:39:54,899 INFO metrics.TopMetrics: NNTop conf: dfs.namenode.top.num.users = 10

2021-09-01 22:39:54,899 INFO metrics.TopMetrics: NNTop conf: dfs.namenode.top.windows.minutes = 1,5,25

2021-09-01 22:39:54,914 INFO namenode.FSNamesystem: Retry cache on namenode is enabled

2021-09-01 22:39:54,914 INFO namenode.FSNamesystem: Retry cache will use 0.03 of total heap and retry cache entry expiry time is 600000 millis

2021-09-01 22:39:54,917 INFO util.GSet: Computing capacity for map NameNodeRetryCache

2021-09-01 22:39:54,917 INFO util.GSet: VM type = 64-bit

2021-09-01 22:39:54,917 INFO util.GSet: 0.029999999329447746% max memory 441 MB = 135.5 KB

2021-09-01 22:39:54,917 INFO util.GSet: capacity = 2^14 = 16384 entries

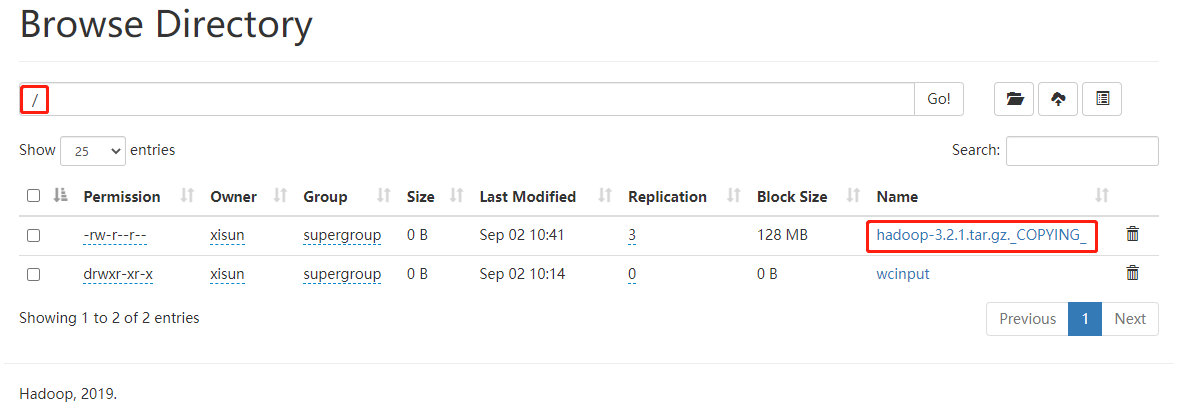

2021-09-01 22:39:55,000 INFO namenode.FSImage: Allocated new BlockPoolId: BP-288566776-192.168.10.102-1630507194979

2021-09-01 22:39:55,144 INFO common.Storage: Storage directory /opt/module/hadoop-3.2.1/data/dfs/name has been successfully formatted.

2021-09-01 22:39:57,641 INFO namenode.FSImageFormatProtobuf: Saving image file /opt/module/hadoop-3.2.1/data/dfs/name/current/fsimage.ckpt_0000000000000000000 using no compression

2021-09-01 22:39:58,078 INFO namenode.FSImageFormatProtobuf: Image file /opt/module/hadoop-3.2.1/data/dfs/name/current/fsimage.ckpt_0000000000000000000 of size 400 bytes saved in 0 seconds .

2021-09-01 22:39:58,126 INFO namenode.NNStorageRetentionManager: Going to retain 1 images with txid >= 0

2021-09-01 22:39:58,206 INFO namenode.FSImage: FSImageSaver clean checkpoint: txid=0 when meet shutdown.

2021-09-01 22:39:58,208 INFO namenode.NameNode: SHUTDOWN_MSG:

/************************************************************

SHUTDOWN_MSG: Shutting down NameNode at hadoop102/192.168.10.102

************************************************************/

[xisun@hadoop102 ~]$ ll /opt/module/hadoop-3.2.1/

总用量 180

drwxr-xr-x. 2 xisun xisun 203 9月 11 2019 bin

drwxrwxr-x. 3 xisun xisun 17 9月 1 22:39 data

drwxr-xr-x. 3 xisun xisun 20 9月 10 2019 etc

drwxr-xr-x. 2 xisun xisun 106 9月 11 2019 include

drwxr-xr-x. 3 xisun xisun 20 9月 11 2019 lib

drwxr-xr-x. 4 xisun xisun 288 9月 11 2019 libexec

-rw-rw-r--. 1 xisun xisun 150569 9月 10 2019 LICENSE.txt

drwxrwxr-x. 2 xisun xisun 38 9月 1 22:39 logs

-rw-rw-r--. 1 xisun xisun 22125 9月 10 2019 NOTICE.txt

-rw-rw-r--. 1 xisun xisun 1361 9月 10 2019 README.txt

drwxr-xr-x. 3 xisun xisun 4096 9月 10 2019 sbin

drwxr-xr-x. 4 xisun xisun 31 9月 11 2019 share

drwxrwxr-x. 2 xisun xisun 22 8月 31 16:00 wcinput

drwxr-xr-x. 2 xisun xisun 88 8月 31 16:04 wcoutput格式化 NameNode 完毕后,会在 Hadoop 安装路径下,生成两个新目录 data 和 logs。

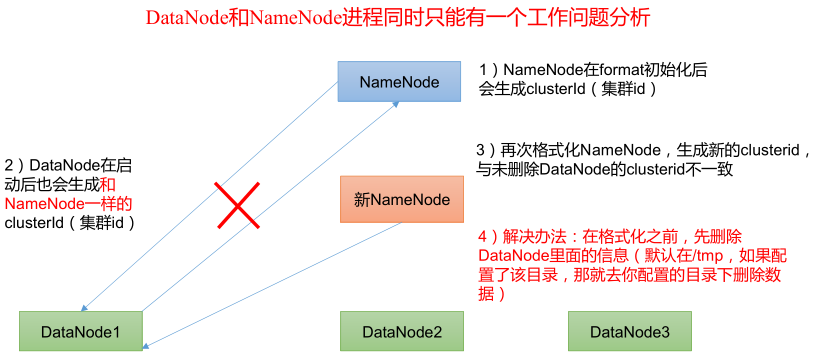

注意:第一次格式化 NameNode 之后,如果再次格式化 NameNode 时,会产生新的集群 id,这会导致与前一次生成的 NameNode 和 DataNode 的集群 id 不一致,集群会找不到已往数据。如果集群在运行过程中发生异常,需要重新格式化 NameNode 的话,一定要先停止 namenode 和 datanode 进程(停止 YARN 和 HDFS),并且删除集群上所有机器的 data 和 logs 目录,然后再进行格式化。最后,重新启动集群。原因如下:

NameNode 的版本号:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43[xisun@hadoop102 ~]$ cd /opt/module/hadoop-3.2.1/data/dfs/

[xisun@hadoop102 dfs]$ ll

总用量 0

drwx------. 3 xisun xisun 40 9月 2 14:05 data

drwxrwxr-x. 3 xisun xisun 40 9月 2 14:05 name

[xisun@hadoop102 dfs]$ cd name/current/

[xisun@hadoop102 current]$ ll

总用量 4196

-rw-rw-r--. 1 xisun xisun 42 9月 1 22:59 edits_0000000000000000001-0000000000000000002

-rw-rw-r--. 1 xisun xisun 42 9月 1 23:59 edits_0000000000000000003-0000000000000000004

-rw-rw-r--. 1 xisun xisun 42 9月 2 00:59 edits_0000000000000000005-0000000000000000006

-rw-rw-r--. 1 xisun xisun 42 9月 2 01:59 edits_0000000000000000007-0000000000000000008

-rw-rw-r--. 1 xisun xisun 42 9月 2 02:59 edits_0000000000000000009-0000000000000000010

-rw-rw-r--. 1 xisun xisun 42 9月 2 03:59 edits_0000000000000000011-0000000000000000012

-rw-rw-r--. 1 xisun xisun 42 9月 2 04:59 edits_0000000000000000013-0000000000000000014

-rw-rw-r--. 1 xisun xisun 42 9月 2 05:59 edits_0000000000000000015-0000000000000000016

-rw-rw-r--. 1 xisun xisun 42 9月 2 06:59 edits_0000000000000000017-0000000000000000018

-rw-rw-r--. 1 xisun xisun 42 9月 2 07:59 edits_0000000000000000019-0000000000000000020

-rw-rw-r--. 1 xisun xisun 42 9月 2 08:59 edits_0000000000000000021-0000000000000000022

-rw-rw-r--. 1 xisun xisun 42 9月 2 09:59 edits_0000000000000000023-0000000000000000024

-rw-rw-r--. 1 xisun xisun 1500 9月 2 10:59 edits_0000000000000000025-0000000000000000045

-rw-rw-r--. 1 xisun xisun 1048576 9月 2 11:34 edits_0000000000000000046-0000000000000000110

-rw-rw-r--. 1 xisun xisun 42 9月 2 11:51 edits_0000000000000000111-0000000000000000112

-rw-rw-r--. 1 xisun xisun 8888 9月 2 12:51 edits_0000000000000000113-0000000000000000185

-rw-rw-r--. 1 xisun xisun 1048576 9月 2 12:51 edits_0000000000000000186-0000000000000000186

-rw-rw-r--. 1 xisun xisun 42 9月 2 13:11 edits_0000000000000000187-0000000000000000188

-rw-rw-r--. 1 xisun xisun 1048576 9月 2 13:18 edits_0000000000000000189-0000000000000000271

-rw-rw-r--. 1 xisun xisun 42 9月 2 14:06 edits_0000000000000000272-0000000000000000273

-rw-rw-r--. 1 xisun xisun 1048576 9月 2 14:10 edits_inprogress_0000000000000000274

-rw-rw-r--. 1 xisun xisun 2460 9月 2 13:11 fsimage_0000000000000000188

-rw-rw-r--. 1 xisun xisun 62 9月 2 13:11 fsimage_0000000000000000188.md5

-rw-rw-r--. 1 xisun xisun 2955 9月 2 14:06 fsimage_0000000000000000273

-rw-rw-r--. 1 xisun xisun 62 9月 2 14:06 fsimage_0000000000000000273.md5

-rw-rw-r--. 1 xisun xisun 4 9月 2 14:06 seen_txid

-rw-rw-r--. 1 xisun xisun 217 9月 1 22:39 VERSION

[xisun@hadoop102 current]$ cat VERSION

#Wed Sep 01 22:39:55 CST 2021

namespaceID=817173371

clusterID=CID-ffd49d0a-1e29-4912-91a7-0d6ce7121fda

cTime=1630507194979

storageType=NAME_NODE

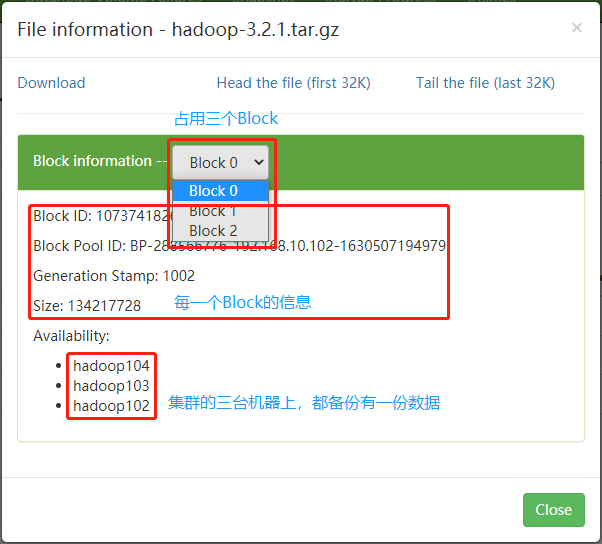

blockpoolID=BP-288566776-192.168.10.102-1630507194979

layoutVersion=-65DataNode 的版本号:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18[xisun@hadoop102 ~]$ cd /opt/module/hadoop-3.2.1/data/dfs/

[xisun@hadoop102 dfs]$ ll

总用量 0

drwx------. 3 xisun xisun 40 9月 2 14:05 data

drwxrwxr-x. 3 xisun xisun 40 9月 2 14:05 name

[xisun@hadoop102 dfs]$ cd data/current/

[xisun@hadoop102 current]$ ll

总用量 4

drwx------. 4 xisun xisun 54 9月 2 14:05 BP-288566776-192.168.10.102-1630507194979

-rw-rw-r--. 1 xisun xisun 229 9月 2 14:05 VERSION

[xisun@hadoop102 current]$ cat VERSION

#Thu Sep 02 14:05:31 CST 2021

storageID=DS-7c2f6c8b-80be-44b0-9905-f1621843d7a3

clusterID=CID-ffd49d0a-1e29-4912-91a7-0d6ce7121fda

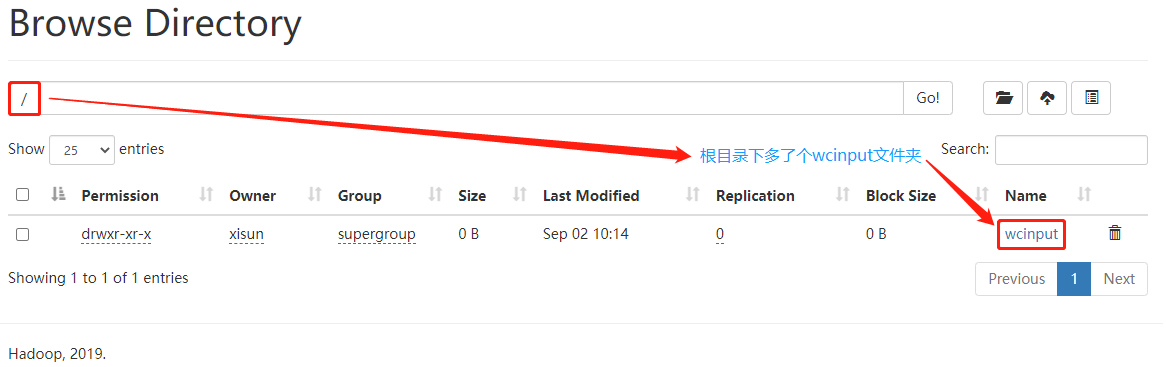

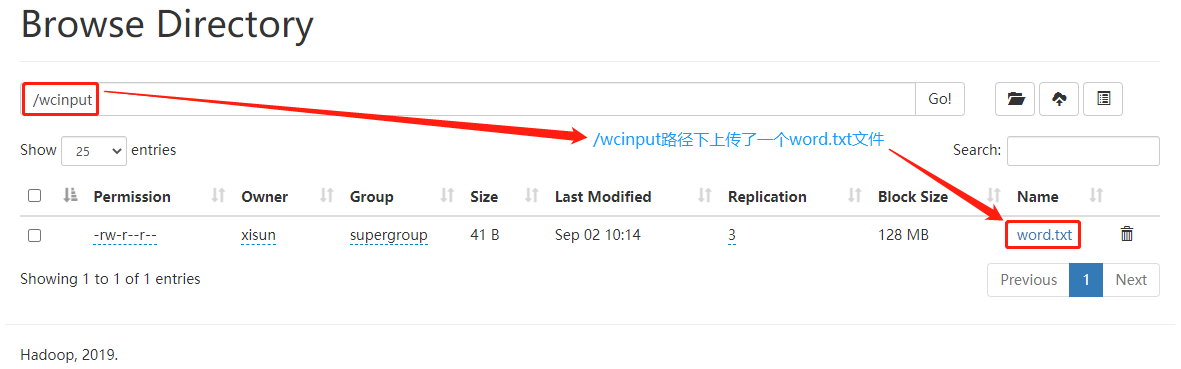

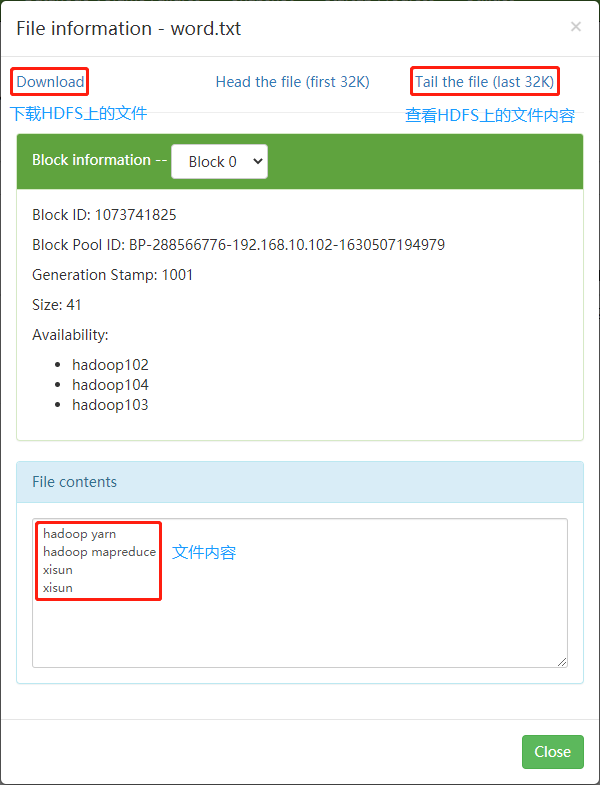

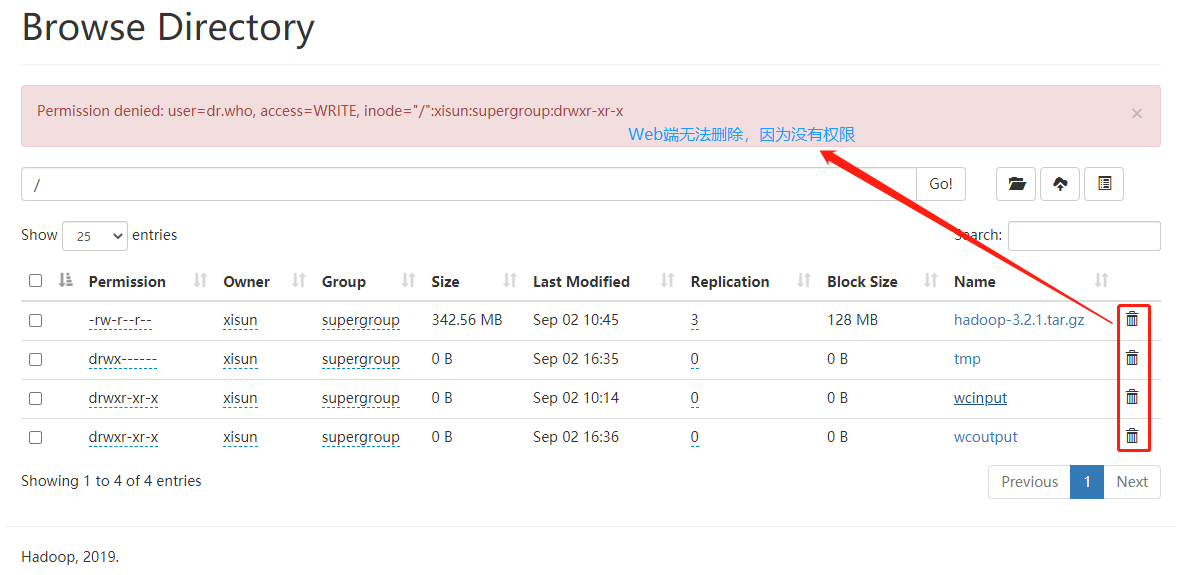

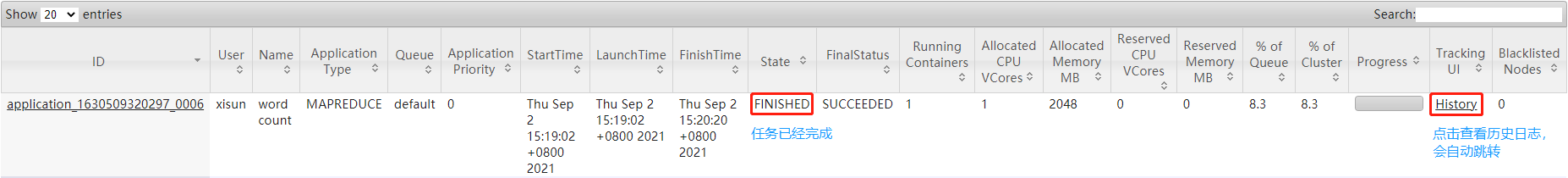

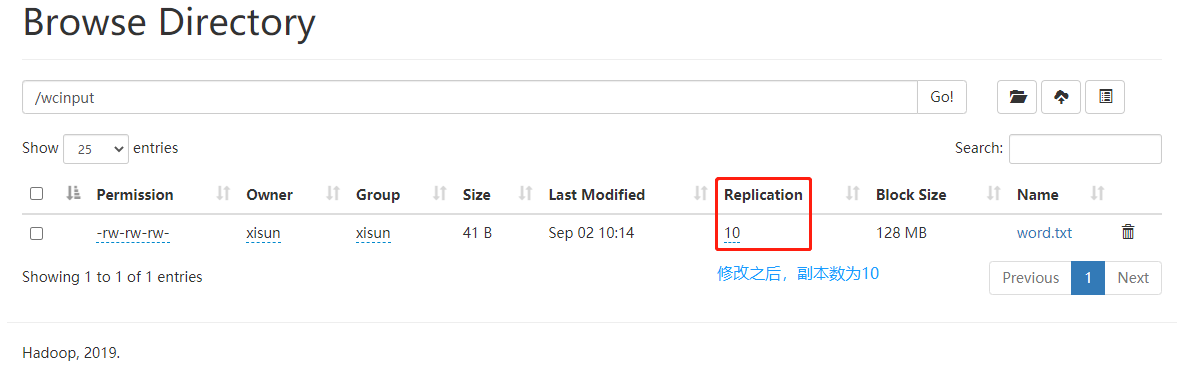

cTime=0